Каждый новый клиент для меня начинается с аудита. За десять лет я провел их больше двух сотен - и почти каждый раз нахожу проблемы, о которых владелец сайта даже не подозревал. Дубли, пожирающие краулинговый бюджет. Токсичные ссылки от прошлого подрядчика. Одинаковый title на трехстах страницах.

Без SEO-анализа продвижение - стрельба вслепую. Я провожу аудит каждому новому клиенту, прежде чем браться за SEO-продвижение. И за годы работы убедился: 80% проблем с видимостью в Яндексе и Google лежат на поверхности - нужно просто знать, куда смотреть.

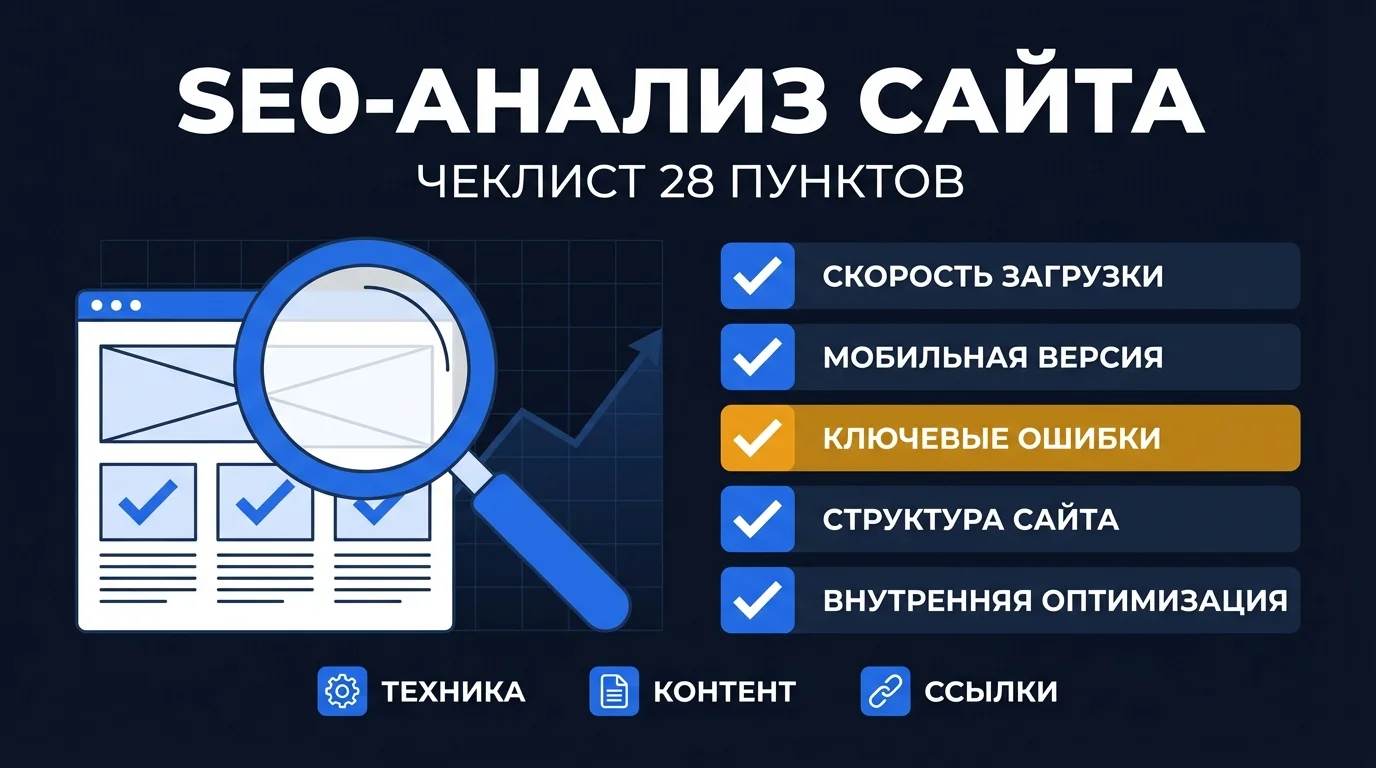

Здесь - 28 пунктов проверки с приоритетами, таблица инструментов и мой подход к аудиту. Проверено на реальных проектах, данные актуальны на март 2026.

Что такое SEO-анализ сайта и зачем он нужен

SEO-анализ сайта и SEO-аудит - по сути одно и то же. Разница в глубине: экспресс-анализ занимает пару часов и ловит критические проблемы, полноценный аудит - несколько дней с разбором каждой страницы. Если сравнивать с медициной: экспресс - осмотр терапевта, полный аудит - обследование с анализами и МРТ. Без такой проверки вы не узнаете, что именно мешает сайту расти.

Кому и когда нужен SEO-аудит? Ситуаций несколько. Вы запускаете продвижение с нуля - без аудита непонятно, с чем работать. Трафик из поиска падает второй месяц подряд - нужно найти причину. Меняете SEO-подрядчика - хотите понять, что предыдущий сделал (или не сделал). Провели редизайн - нужно проверить, не сломалась ли индексация. А еще - после крупных обновлений алгоритмов Google или Яндекса, когда правила игры меняются.

Разовая проверка отличается от системного подхода. Можно открыть PageSpeed, увидеть оценку 45 из 100 и решить, что проблема в скорости. Но часто корень глубже - дубли страниц, каннибализация запросов, токсичные ссылки. SEO-анализ показывает картину целиком: технику, контент, ссылки, коммерческие факторы, юзабилити.

Если ищете подрядчика по SEO и хотите оценить качество его работы - этот чеклист поможет задать правильные вопросы. Профессиональный аудит включает минимум 20-25 пунктов. Вам прислали отчет на две страницы? Это не аудит, а формальность.

Что я проверяю первым у нового клиента

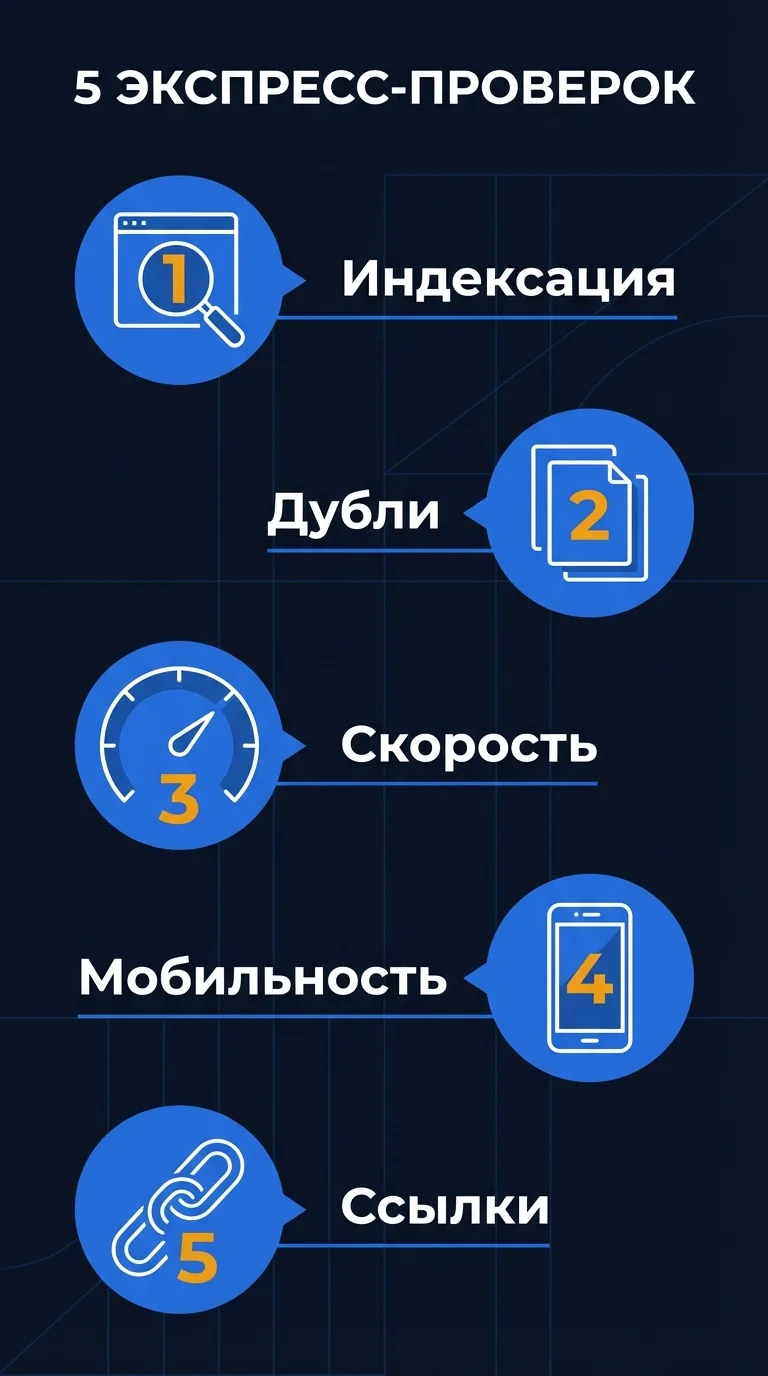

За 10 лет у меня сложился свой порядок. Когда приходит новый проект, я не открываю сразу Screaming Frog и не лезу в ссылочный профиль. Начинаю с пяти точек, которые покрывают 80% типичных проблем. Это мой минимальный SEO-анализ сайта - базовая проверка, с которой стартует любой проект.

Первое - индексация. Набираю в Яндексе site:domain.ru и считаю количество страниц. Потом сравниваю с тем, сколько страниц реально должно быть в индексе. Однажды у клиента из e-commerce в индексе было 45 000 страниц при ассортименте в 3 000 товаров. Остальные 42 000 - дубли фильтров, пустые страницы пагинации, технический мусор. Яндекс тратил краулинговый бюджет впустую, а нужные карточки товаров не попадали в выдачу. После чистки и настройки robots.txt трафик начал расти через три недели.

Второе - дубли и каннибализация. Каннибализация - это когда две или больше страниц сайта конкурируют друг с другом по одному запросу. Вроде бы контент есть, страницы проиндексированы, а позиции размыты. Встречается чаще, чем думают. Проверяю через Google Search Console: если по одному запросу показываются разные URL - значит, поисковик не может определить главную страницу. Решение: объединить контент или четко разделить семантику между страницами.

Третье - скорость загрузки. Открываю PageSpeed Insights, причем всегда смотрю именно мобильную версию - она показательнее. На что ориентируюсь: LCP (загрузка основного контента) должен уложиться в 2,5 секунды, INP (отзывчивость на клики и нажатия) - не дольше 200 мс, а сдвиг верстки CLS - не больше 0,1. HTTP Archive показывает, что только 48% сайтов укладываются в LCP-норматив на телефонах. Если ваш сайт попадает в эту половину - уже хорошо. Подробный разбор метрик скорости - в статье о скорости загрузки.

Четвертое - мобильная адаптация. Google давно перешел на mobile-first indexing. Яндекс - туда же. Открываю сайт на телефоне (не в эмуляторе, а на реальном устройстве) и проверяю: кнопки нажимаются? Текст читается без масштабирования? Формы заполняются удобно? Примерно в каждом третьем проекте нахожу проблемы с мобильной версией, которые владелец не замечал - он же открывает свой сайт с десктопа.

Пятое - ссылочный профиль. Здесь ищу токсичные ссылки: спам, PBN-сетки, доноры из нерелевантных тематик. Яндекс к этому относится жестко - сайт с накрученными ссылками пессимизируется, и выбраться потом непросто. Где смотрю: первым делом Яндекс.Вебмастер, раздел «Внешние ссылки». Если у клиента есть бюджет - подключаю Ahrefs. Обязательно сравниваю число ссылающихся доменов с теми, кто сидит в топ-10 по целевым запросам. Разрыв в 5-10 раз - ясный сигнал, что ссылочной массы не хватает.

По моему опыту, эти пять проверок закрывают большинство вопросов «почему мы не растем». Дальше - детальный разбор по категориям.

Нужен профессиональный SEO-аудит?

Проведу анализ вашего сайта и покажу точки роста. Первичная консультация - бесплатно.

Десять технических проверок

Техническая часть - фундамент. Если robots.txt закрывает половину сайта от индексации, никакой контент не поможет. Проще говоря, сначала чиним фундамент, потом строим дом. Вот что проверять и чем.

1. robots.txt - откройте файл по адресу domain.ru/robots.txt и пройдитесь по каждой директиве Disallow. Казалось бы, мелочь. Но я встречал ситуации, когда разработчик при переносе сайта на боевой сервер забыл убрать Disallow: / - и весь ресурс провалился из поисковой выдачи за считанные дни.

2. Sitemap.xml - XML-карта сайта должна быть свежей и без ошибок. Её нужно добавить в обе панели вебмастеров: и в яндексовскую, и в гугловскую. Посмотрите, нет ли в карте адресов, которые ведут на несуществующие страницы или уходят в редирект. Часто вижу одну и ту же историю: sitemap сгенерировали при запуске и забыли. CMS добавляет новый контент, а в карту он не попадает. Роботы находят эти страницы сами, но с заметной задержкой.

3. Индексация - проверяю через оператор site: в обоих поисковиках, плюс смотрю отчеты в панелях вебмастеров. Главное - сравнить: сколько страниц в индексе и сколько реально полезных URL на сайте. Если разница в 2-3 раза - скорее всего, индекс забит дублями или техническим мусором.

4. Каноникалы (rel=canonical) - ищу противоречия в разметке. Классическая путаница: одна страница указывает каноникалом саму себя, а ее дубль ссылается на третью версию. Поисковый робот теряется, и в результате ни одна из версий не получает полный ссылочный вес.

5. Дубли страниц - вариации URL: с www и без, http и https, с косой чертой на конце и без нее. Каждая такая пара - потенциальный дубль. Все они должны уходить через 301-редирект на единственную каноническую версию. Screaming Frog за один проход покажет, какие URL содержат одинаковый контент.

6. HTTPS - каждая страница должна открываться по защищенному протоколу. Отдельная ловушка - смешанный контент, когда сама страница на HTTPS, а часть картинок или скриптов тянется по HTTP. Браузер выдает предупреждение о небезопасном соединении, а поисковик может понизить такую страницу.

7. Скорость загрузки - замеряю через PageSpeed Insights, там видны все три метрики: LCP, INP и CLS. Важная деталь: в марте 2024-го Google убрал FID и ввел вместо него INP - метрику отзывчивости на взаимодействие. Из-за этого многие сайты, которые раньше проходили проверку, теперь не укладываются в норматив. И ещё: для ранжирования Google берет не лабораторные оценки Lighthouse, а полевые данные реальных посетителей из CrUX. Ориентир - 75-й перцентиль в отчетах Search Console.

8. Мобильная адаптация - тестирую через Lighthouse в Chrome DevTools или через раздел «Удобство для мобильных» в Search Console. Отдельный инструмент Mobile-Friendly Test Google убрал в конце 2023-го. Обязательно проверяйте не только главную. Карточки товаров, длинные статьи, формы заказа - именно там чаще всего ломается верстка. Самая частая проблема - горизонтальный скролл на телефоне из-за таблиц или картинок без ограничения ширины.

9. Редиректы - найдите цепочки (301 → 301 → целевая) и замените на прямые. Редиректы 302 (временные) на постоянных URL замените на 301. Каждое звено в цепочке теряет часть ссылочного веса.

10. Битые ссылки - и внутренние, и те, что ведут на чужие сайты. Screaming Frog находит их все за один проход сканирования. Каждый мертвый URL - это потеря ссылочного веса и пользователь, уткнувшийся в тупик. Особенно плохо, когда битые адреса указаны в XML-карте сайта. Робот заходит на них раз за разом, расходует квоту обхода и накапливает ошибки в панели вебмастера.

Проверка noindex

Проверьте ещё один момент: не стоит ли случайный noindex на страницах, которые должны быть в поиске. В Яндекс.Вебмастере откройте «Индексирование», далее «Страницы в поиске» - там видно, какие URL исключены из индекса и почему. Одна забытая директива noindex на странице каталога - и минус десятки процентов трафика.

Контент и метаданные

Техника - фундамент. А контент - то, ради чего человек вообще заходит на сайт. Поисковые алгоритмы в 2026-м разбираются в тексте на уровне смысла, а не подсчитывают вхождения ключевых фраз. При этом базовые вещи никуда не делись: уникальные мета-теги на каждой странице, грамотная структура заголовков, объем текста, достаточный для раскрытия темы.

Title и Description. У каждой страницы они должны быть своими. Title - 50-60 символов, с основным поисковым запросом. Description - 140-160 символов, и он должен дополнять title, а не повторять его слово в слово. В Яндекс.Вебмастере есть удобный раздел «Диагностика» - он покажет, где мета-теги дублируются. Типичная проблема, которую вижу постоянно: CMS подставляет один и тот же title на все страницы каталога, меняя только номер пагинации. В итоге 200 страниц с одинаковым заголовком.

Заголовки H1-H6. H1 - один на странице, и в нем должен быть основной запрос. Дальше H2 и H3 формируют логику повествования. Нельзя перескакивать уровни: если после H1 идет сразу H3 без H2 - это ошибка структуры. В Screaming Frog удобно проверять заголовки массово - он вытащит H1-H6 со всех страниц за один проход.

Тонкий контент. Если на странице меньше 300 слов - поисковик, скорее всего, сочтет ее малоинформативной. Карточки товаров и страницы категорий страдают от этого чаще всего. Что делать? Либо добавить полезный текст (описание, характеристики, сценарии использования), либо закрыть страницу от индексации через noindex. По моим наблюдениям, тонкие страницы - причина слабого ранжирования примерно у 40% интернет-магазинов, с которыми я работал.

Каннибализация. Когда две страницы сайта конкурируют по одному и тому же запросу - обе теряют позиции. Проверяется просто: в Google Search Console открываете отчет «Эффективность», фильтруете по запросу и смотрите, сколько разных URL показывается. Больше одного? Значит, каннибализация. Решение - объединить страницы в одну мощную или развести семантику так, чтобы каждая отвечала на свой кластер запросов.

Alt-теги изображений. Описательный alt-текст помогает поисковикам понять содержание картинки. Для e-commerce - это дополнительный трафик из Google Картинок и Яндекс.Картинок. Пустые alt-теги - упущенная возможность.

E-E-A-T сигналы. Декабрьское обновление Google 2025 года расширило требования E-E-A-T (опыт, экспертиза, авторитет, доверие) далеко за пределы YMYL-тематик. Теперь это актуально для любых конкурентных ниш. Яндекс пошел еще дальше - в марте 2025-го заявил, что распознает AI-тексты без экспертной доработки с точностью 99%. При аудите обращайте внимание: указано ли авторство материалов? Есть ли страница «Об авторе» с биографией? Стоят ли актуальные даты публикации и обновления? Я разбирал эту тему подробно в руководстве по SEO-продвижению.

Анализ ссылочного профиля

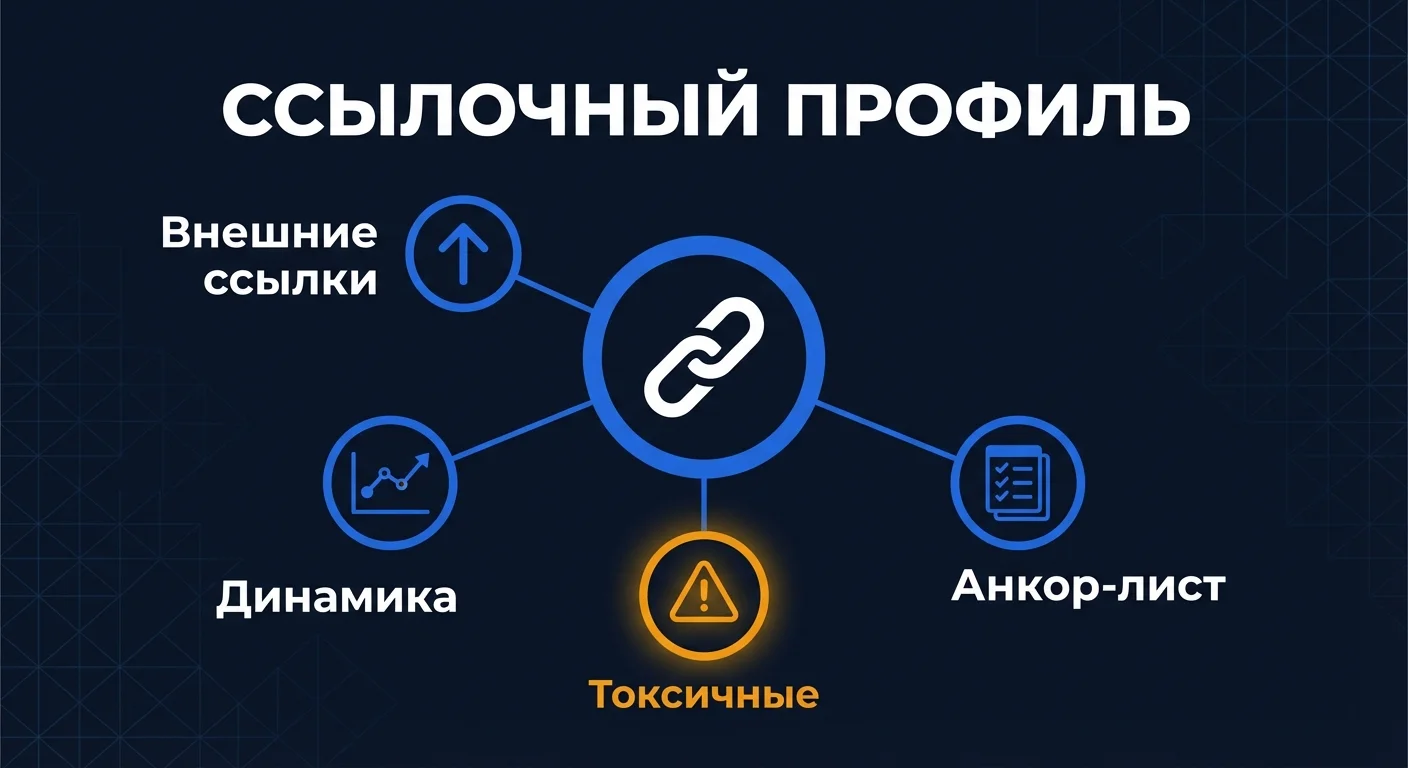

Ссылки до сих пор влияют на позиции - и в Яндексе, и в Google. Но десять качественных ссылок с тематических площадок бьют тысячу из каталогов. Что именно проверять:

Количество и качество внешних ссылок. Первый шаг - сравнить свой профиль с конкурентами, которые занимают топ-10 по вашим запросам. Это дает ориентир. Одна ссылка с тематической площадки перевесит десяток ссылок из бесплатных каталогов. Полезный прием: посмотрите, откуда получают ссылки конкуренты - это готовый список площадок для собственного продвижения.

Анкор-лист. Распределение текстов ссылок должно выглядеть органично. Если 80% анкоров - это «купить окна Москва», поисковик сразу видит манипуляцию. Здоровый профиль: примерно треть URL-анкоров (голый адрес сайта), около четверти - брендовые упоминания, остальное - разбавленные фразы и общие слова вроде «тут», «подробнее», «на сайте».

Токсичные ссылки. Спам-сайты, PBN-сетки, площадки с навязчивой рекламой, доноры из совершенно чужих тематик. В Яндекс.Вебмастере список внешних ссылок есть, но оценки токсичности нет - это придется делать самостоятельно. Ahrefs или Semrush автоматизируют процесс, но и без них можно: откройте список доноров из Вебмастера и пройдитесь по каждому вручную. Долго, зато бесплатно.

Динамика наращивания. Ссылочная масса должна расти плавно. Если год у сайта было 50 ссылающихся доменов, а потом за месяц появилось 500 - поисковик воспримет это как манипуляцию. Санкции почти гарантированы. Отследить динамику можно в Ahrefs (там есть график Referring domains over time) или бесплатно - просто сравнивайте данные из Яндекс.Вебмастера за разные месяцы.

В моей практике ссылочный профиль - та область, где чаще всего находишь «скелеты в шкафу». Предыдущий подрядчик закупал ссылки на биржах, клиент об этом не знает, а Яндекс уже пессимизирует сайт. Разгребать такое приходится месяцами - снимать ссылки, отправлять Disavow, ждать переобхода.

Коммерческие факторы и юзабилити

Яндекс выделяет коммерческие факторы в отдельную категорию ранжирования - и проверяет их жестко. Google тоже оценивает доверие к бизнесу, но не так явно. Если у вас интернет-магазин или сайт услуг - эта часть аудита обязательна.

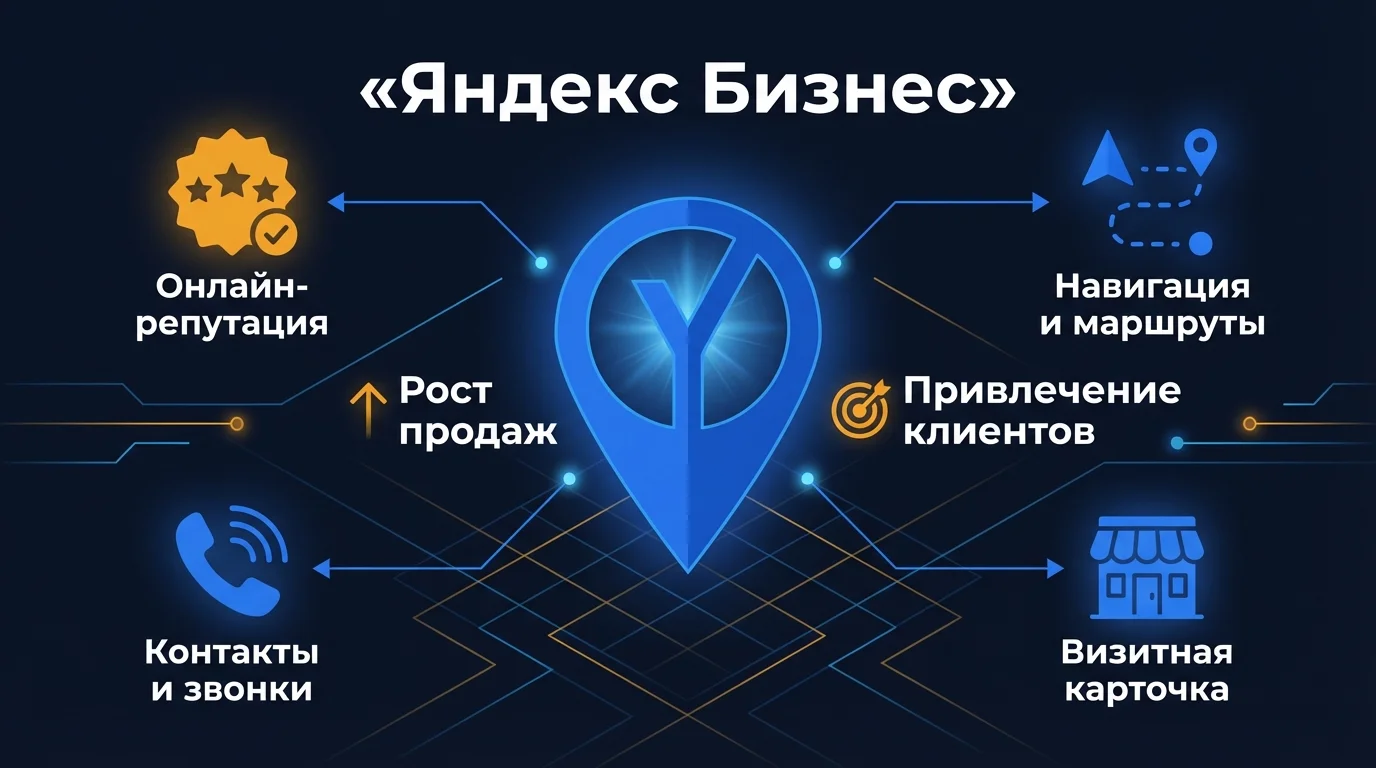

Контактная информация. Адрес, телефон, схема проезда - все это должно быть легко найти. Для Яндекса отдельно проверьте: указаны ли на странице контактов ИНН и ОГРН? Нейросети Яндекса сверяют данные с реестром ЕГРЮЛ. Расхождение адреса на сайте и в реестре - удар по доверию алгоритма.

Страницы доставки, оплаты, гарантий. Для интернет-магазинов - обязательны. Нет страницы доставки? Яндекс это заметит. Алгоритм проверяет наличие условий возврата, способов оплаты и сроков - и снижает доверие, если чего-то не хватает.

Цены на сайте. «Цена по запросу» - плохой сигнал. Яндекс предпочитает сайты, где цена видна сразу. Если точную цену указать нельзя - укажите диапазон: «от 15 000 рублей» лучше, чем ничего.

Юзабилити. Навигация, хлебные крошки, внутренний поиск, формы обратной связи. Проверьте: сколько кликов от главной до нужной страницы? Больше трех - плохо. Удобная навигация удерживает пользователя и улучшает поведенческие метрики. Отдельно проверьте внутреннюю перелинковку - нет ли «сиротских» страниц, на которые не ведет ни одна ссылка с других страниц сайта.

Поведенческие факторы. Яндекс напрямую учитывает, как люди ведут себя на сайте: процент отказов, сколько страниц просмотрели, сколько времени провели. Если посетители уходят за 10 секунд - это красноречивый сигнал: либо контент не соответствует запросу, либо что-то отталкивает в интерфейсе. О том, как поведенческие метрики связаны с бюджетом на продвижение, я писал в статье сколько стоит SEO-продвижение.

Бесплатные

Платные

Инструменты для SEO-анализа

Какие инструменты нужны для SEO-анализа? Ну вот мой набор - разбил по категориям: бесплатные и платные, с указанием, что проверяет каждый.

| Инструмент | Тип | Что проверяет | Когда использовать |

|---|---|---|---|

| Яндекс.Вебмастер | Бесплатный | Индексация, диагностика, внешние ссылки, ИКС | Всегда - основной инструмент для Яндекса |

| Google Search Console | Бесплатный | Покрытие индекса, Core Web Vitals, мобильность, structured data | Всегда - данные напрямую от Google |

| PageSpeed Insights | Бесплатный | Скорость загрузки, LCP, INP, CLS | При техническом аудите |

| Screaming Frog | Бесплатный до 500 URL | Технический краулинг: редиректы, 404, дубли, мета-теги | Полный технический аудит |

| Keys.so | Платный | Семантика, позиции, конкуренты в Яндексе | Контентный аудит и анализ конкурентов |

| PR-CY | Бесплатный (базовый) | Экспресс-проверка сайта: позиции, ИКС, техничка | Быстрая оценка |

| Be1.ru | Бесплатный | Позиции, индексация, мета-теги | Экспресс-проверки |

| Ahrefs / Semrush | Платный | Ссылочный профиль, позиции, конкуренты | Глубокий ссылочный аудит |

Для работы в рунете без двух сервисов не обойтись: Яндекс.Вебмастер и Keys.so. Западные платформы заточены под Google, а на российском рынке Яндекс занимает около 70% (данные на конец 2025 года). Вебмастер покажет индексацию, проблемы на сайте, входящие ссылки и ИКС. Гугловская Search Console - статус покрытия индекса, скоростные метрики, проблемы с мобильностью и ошибки в разметке. Оба сервиса бесплатны. По моему опыту, для четырех из пяти повседневных задач этого набора достаточно.

Screaming Frog в бесплатной версии сканирует до 500 URL - малому и среднему бизнесу этого достаточно. Крупным сайтам понадобится лицензия за £199 в год. Главное преимущество перед онлайн-сервисами: программа работает на вашем компьютере и выгружает полную картину - каждый URL, каждый мета-тег, каждый редирект и каждая битая ссылка.

Keys.so - главный российский инструмент для анализа семантики и конкурентов в Яндексе. По каким запросам ранжируется сайт, какие позиции, кто конкуренты по семантическому ядру - все здесь. Ни Ahrefs, ни Semrush не дают такой глубины данных по Яндексу.

Совет по инструментам

Не гонитесь за дорогими сервисами. Связка из Яндекс.Вебмастера, гугловской Search Console и бесплатного Screaming Frog покрывает основную часть проверок при стандартном аудите. Платные подписки нужны, когда дело доходит до глубокого ссылочного анализа или разведки конкурентов.

Как составить отчет по SEO-аудиту

Провели анализ, нашли 30 проблем - а что дальше? Без структурированного отчета результаты теряются. Нужна ясность: что чинить первым, что потом, а что может подождать.

Структура отчета:

- Резюме на одну страницу - критические проблемы и главные рекомендации

- Детальные находки по категориям: техника, контент, ссылки, коммерческие факторы

- Рекомендации с приоритетами и примерными сроками реализации

Приоритизация - то, чего не хватает большинству чеклистов. Грубо говоря, плоский список из 30 пунктов без порядка бесполезен. Нужны три уровня:

- Критично - блокирует индексацию или ранжирование. Чинить немедленно.

- Важно - влияет на позиции. Чинить в течение месяца.

- Желательно - улучшает UX и конверсию. Планировать в бэклог.

Каждая рекомендация должна содержать: URL проблемной страницы, описание ошибки, конкретный шаг по исправлению. «Улучшить контент» - не рекомендация. «Добавить 500 слов уникального текста с описанием товара на страницу /catalog/stoly/ - чтобы закрыть thin content» - рекомендация.

Если аудит делает подрядчик - смотрите на красные флаги. Отчет без конкретных URL и скриншотов? Формальность. Рекомендации вида «улучшить контент» без указания страниц? Тоже. Я за годы работы выработал правило: хороший отчет - тот, по которому разработчик может сесть и начать чинить, не задавая вопросов.

Хотите получить профессиональный отчет?

Проведу SEO-анализ вашего сайта с приоритизацией задач и конкретным планом действий.

Полный чеклист на 28 пунктов

Это полный чеклист SEO-анализа сайта, который я использую в работе. Пункты разбиты по приоритетам - начинайте с критичных.

Критично - блокирует индексацию или ранжирование

- robots.txt - убедиться, что нужные разделы не заблокированы

- sitemap.xml - актуален, без ошибок, добавлен в GSC и Вебмастер

- Индексация - сравнить

site:domainс реальным количеством полезных URL - Каноникалы (

rel=canonical) - нет ли противоречий между версиями страниц - Дубли - www/без www, http/https, trailing slash, все ведут 301 на каноническую версию

- HTTPS - все страницы и ресурсы на защищенном протоколе

- Мобильная адаптация - проверить не только главную, но и карточки товаров, формы, статьи

- Отсутствие случайных

noindexна страницах, которые должны быть в поиске

Критичные проверки

Важно - влияет на ранжирование

- Скоростные метрики (LCP, INP, CLS) - замерить через PageSpeed Insights

- Мета-теги title и description - своя формулировка на каждой странице, длина в рамках нормы, целевой запрос присутствует

- Заголовок H1 - ровно один на странице, с основным поисковым запросом

- Тонкий контент - страницы с текстом короче 300 слов, в первую очередь карточки товаров

- Каннибализация - несколько страниц борются за один запрос

- Ссылочный профиль - нет ли токсичных или спамных доноров

- Редиректы - убрать цепочки, 302 заменить на 301

- Битые ссылки - внутренние и исходящие URL, возвращающие ошибку 404

- Alt-теги изображений - описательные, не пустые

- Structured data (JSON-LD) - валидность через Rich Results Test

Важные проверки

Желательно - улучшает UX и конверсию

- Глубина вложенности - не более трех кликов от главной до любой страницы

- Внутренняя перелинковка - нет ли «сиротских» страниц без входящих ссылок

- Хлебные крошки - наличие и корректная иерархия

- Коммерческие факторы (Яндекс) - контакты, цены, доставка, реквизиты

- Юзабилити - навигация, формы, удобство на мобильных

- E-E-A-T сигналы - указан автор, есть биография, даты обновления актуальны

- Open Graph и карточки для соцсетей

- Поведенческие метрики - процент отказов, число просмотренных страниц, продолжительность визита

- Оптимизация под AI-поисковики - FAQ-разметка, definition-блоки, нумерованные списки

- Файл llms.txt - доступность контента для LLM-краулеров

Желательные проверки

Про AI-оптимизацию

Пункты 27-28 - новая реальность 2026 года. На vc.ru уже выделяют нейро-SEO как отдельный блок аудита: оптимизация под AI Overviews, ChatGPT, Perplexity. FAQ-разметка, самодостаточные definition-блоки и нумерованные списки повышают шансы на цитирование AI-поисковиками.

Как часто проводить SEO-аудит

Универсального ответа нет, но ориентиры есть.

Полный SEO-аудит - один-два раза в год. Весной и осенью, когда основные алгоритмические обновления уже выкатились и стабилизировались. На полном аудите проверяются все 28 пунктов из чеклиста выше.

Технический мониторинг - ежемесячно. Проверка индексации, ошибок 404, скорости. Настройте уведомления в Google Search Console и Яндекс.Вебмастере - они пришлют письмо, если что-то сломается. Регулярный мониторинг ловит проблемы на ранней стадии, пока они не успели повлиять на трафик.

Внеплановый SEO-анализ нужен, если:

- Трафик из поиска упал более чем на 20% за месяц

- Google или Яндекс выкатили крупное обновление алгоритмов

- Вы провели редизайн, миграцию или сменили CMS

- Меняете SEO-подрядчика

- Конкуренты резко выросли по вашим запросам

Один мой клиент из интернет-магазина мебели провел миграцию с Bitrix на самописную CMS - и не уведомил меня. Через две недели трафик упал на 60%. При аудите обнаружилось: 1200 редиректов не настроены, старые URL возвращают 404, sitemap не обновлен. Восстановление заняло полтора месяца. Если бы анализ провели до миграции - проблемы бы не было.

Автоматизируйте что можете. Screaming Frog позволяет настроить регулярные краулы по расписанию. Яндекс.Вебмастер и GSC отправляют уведомления при критических ошибках. Это не заменит полноценный SEO-аудит сайта, но поможет поймать проблему на ранней стадии - пока потеря трафика не стала катастрофой. По моему опыту, каждый следующий аудит идет быстрее предыдущего: основные проблемы уже решены, остается мониторить новые. Накопительный эффект.

Охват проверок по инструментам, %

Источник: Обзор SEOTOP, 2026

Нужна помощь с SEO-анализом?

Проведу аудит вашего сайта, покажу проблемы и составлю план действий с приоритетами.

Если после прочтения чеклиста стало ясно, что анализ нужен, а разбираться самому некогда - напишите мне в Telegram. Посмотрю ваш сайт, покажу основные проблемы и дам рекомендации. Первичный анализ делаю бесплатно. Подробнее об эксперте.