Каждый второй клиент, который приходит ко мне на консультацию, задает один и тот же вопрос: «Почему мой сайт не в топе?» И ответ всегда начинается с одного - как поисковики решают, кого показать первым. За 10 лет работы я разобрал эту механику до винтиков. Здесь - все, что знаю про ранжирование в Яндексе и Google: алгоритмы, факторы и что реально определяет позиции в 2026 году.

Ранжирование - механизм, который определяет судьбу каждого сайта в выдаче. Поисковик берет запрос, прогоняет через сотни фильтров и расставляет страницы в порядке убывания пользы. Контент, ссылки, скорость, поведение посетителей - все идет в расчет. Дальше - разбор по косточкам: что конкретно влияет на позиции и почему.

Что такое ранжирование в поисковых системах

Когда человек вводит запрос в Яндексе или Google, поисковик за доли секунды просматривает миллиарды страниц в своем индексе и выстраивает их в порядке убывания полезности. Этот процесс и называется ранжированием.

Путаница возникает с индексацией. Индексация - это когда робот нашел вашу страницу и добавил ее в базу. Ранжирование - когда алгоритм решил, на какой позиции ее показать. Страница может быть проиндексирована, но висеть на сотой позиции - а значит, ее никто не увидит.

Аналогия простая: индексация - это попасть в библиотеку. Ранжирование - оказаться на полке у входа, а не в подвале.

И вот что еще важно: ранжирование - процесс динамический. Позиции пересчитываются при каждом запросе с учетом текущих данных. Сегодня ваш сайт на пятом месте, завтра - на восьмом, через неделю - на третьем. Это нормально.

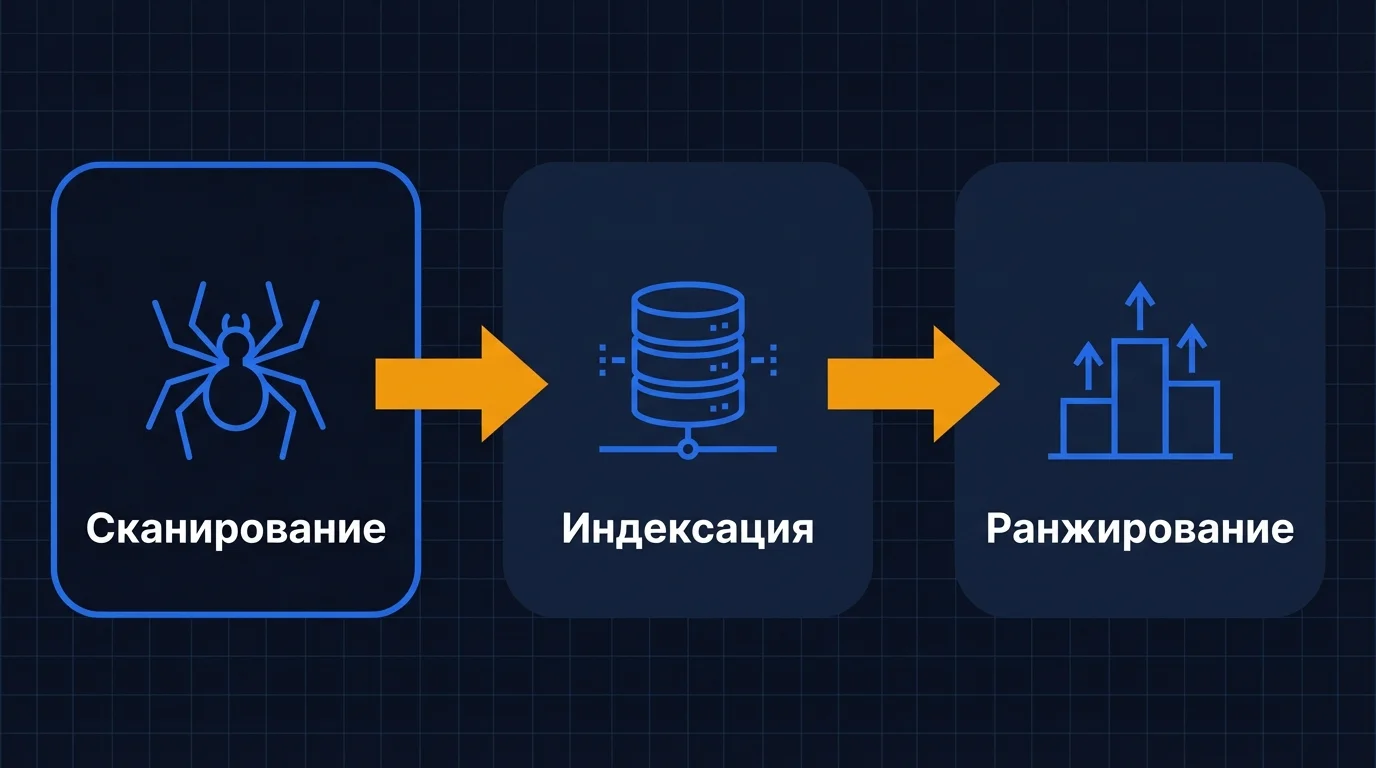

Как работает ранжирование на практике

Если упростить, все проходит через три стадии. Первая - сканирование: робот-краулер обходит сайты, загружает HTML, собирает информацию со страниц. Вторая - индексация: система разбирает собранное, раскладывает по полочкам - текст отдельно, ссылки отдельно, метаинформация отдельно. Третья - собственно ранжирование: когда пользователь вводит запрос, алгоритм за миллисекунды перебирает релевантные документы из индекса и выстраивает их в порядке полезности.

Три стадии: от сканирования до определения позиций в выдаче

Третья стадия - самая интересная. Алгоритм сравнивает запрос с содержимым страниц, взвешивает десятки параметров и выставляет каждому документу балл. Набрал выше - стоишь выше в выдаче. И тут есть нюанс: вес параметров плавает. Для коммерческих запросов на первый план выходят цены, контакты, карточки товаров. Для информационных - насколько полно страница закрывает вопрос.

Часто вижу, как владельцы сайтов фокусируются только на индексации: «Робот нашел мою страницу - значит, все хорошо». На деле это лишь первый шаг. Настоящая работа начинается, когда нужно подняться из сотни в десятку. А тут без понимания правил игры - никуда.

Как ранжирует Яндекс - MatrixNet, YATI и Нейро

Яндекс занимает 69,3% российского поискового рынка по данным за 2025 год. Если вы работаете на Россию - это главный поисковик, и его алгоритмы нужно знать.

Эволюция алгоритмов Яндекса: от MatrixNet до генеративного поиска

MatrixNet (с 2009 года) - система машинного обучения на основе градиентного бустинга. Она комбинирует сотни факторов ранжирования, присваивая каждому свой вес. По данным Яндекса, в формировании выдачи участвуют около 2000 различных алгоритмов. Именно MatrixNet сделал старые методы SEO нерабочими - ведь подкрутить один фактор, когда их тысячи, уже недостаточно.

Королев (2017) научил Яндекс понимать смысл запроса, а не просто сопоставлять слова. До него поисковик искал страницы с точным вхождением ключевых слов. После - начал понимать, что «как избавиться от головной боли» и «средства от мигрени» - это про одно и то же.

YATI (конец 2020 года) - алгоритм на основе трансформера, аналогичного BERT от Google. Он анализирует контекст слов в запросе и на странице, и длинные сложные запросы стал понимать заметно лучше. Для практика это значит одно: писать «под ключи» бессмысленно, нужно отвечать на вопрос пользователя.

Яндекс Нейро (2025-2026) - генеративные ответы прямо в выдаче. Алиса на YandexGPT 5 сама ищет информацию в интернете и формирует готовый ответ со ссылками на источники.

Отдельная история - антифрод поведенческих факторов. По данным Яндекса, нейросеть распознает накрутку ПФ с точностью 99%. За 10 лет я видел десятки сайтов, попавших под этот фильтр - выход из-под него занимает месяцы. Не преувеличиваю. Подробнее - в статье про поведенческие факторы ранжирования.

Алгоритмы Google - от PageRank до AI Overviews

Если Яндекс пришел к нейросетям через MatrixNet, то Google двигался своей дорогой - от простого подсчета ссылок к нейросетевому пониманию контента.

Ключевые алгоритмы Google: от машинного обучения до генеративного поиска

RankBrain (2015) стал первым AI-алгоритмом Google. По данным Bloomberg, на старте он обрабатывал около 15% новых запросов, с которыми поисковик раньше не сталкивался. Сейчас RankBrain участвует в обработке практически всех запросов.

BERT (2019) - двунаправленный анализ контекста слов. При запуске затронул 10% всех поисковых запросов. До BERT Google мог неправильно интерпретировать предлоги и частицы. После - научился понимать, что «рейс из Москвы в Париж» и «рейс из Парижа в Москву» - разные запросы.

NavBoost - система, о которой стало известно после утечки внутренней документации Google в 2024 году. Она учитывает клики пользователей за последние 13 месяцев: goodClicks (пользователь нашел ответ), badClicks (быстрый возврат в выдачу), lastLongestClicks (последний длительный клик - один из сильнейших сигналов). По сути, NavBoost объясняет, почему поведенческие факторы так важны и в Google тоже.

December 2025 Core Update - одно из самых значимых обновлений последних лет. Google ужесточил контроль AI-контента, поднял порог авторской достоверности и расширил требования E-E-A-T на все конкурентные запросы. Что это означает для продвижения - разобрал в руководстве по SEO в 2026 году.

AI Overviews - генеративные блоки Google, которые занимают верх выдачи уже по 60% запросов и больше. Что это значит для бизнеса? Часть кликов просто испаряется - человек получил ответ и не переходит ни на один сайт. Чтобы попасть в эти ответы, нужна GEO-оптимизация контента - отдельная дисциплина со своими принципами.

NavBoost и поведение пользователей

После утечки внутренних документов Google стало ясно: пользовательские клики - прямой сигнал для алгоритма. Посетитель вернулся в поиск через 5 секунд? Плохой знак. Остался на странице, прочитал до конца? Позиции со временем подрастут.

Факторы ранжирования в 2026 году

Факторов - сотни, если не тысячи. Но я привык раскладывать их по пяти корзинам:

Пять корзин факторов, которые определяют позиции сайта

- Контент - отвечает ли страница на запрос, насколько глубоко раскрыта тема, кто автор и можно ли ему доверять (E-E-A-T)

- Поведение пользователей - кликабельность сниппета (CTR), время чтения, переходы внутри сайта, возвраты в поисковую выдачу

- Техника - время отклика сервера, мобильная версия, показатели Core Web Vitals, отсутствие ошибок сканирования

- Ссылки - сколько внешних сайтов ссылается, насколько они авторитетны, разнообразие анкоров

- Коммерческие сигналы (актуальны для транзакционных запросов) - цены на странице, реквизиты, условия оплаты и доставки

Что перевесит? Зависит от тематики и поисковика. Но вот что я наблюдаю постоянно: сайт с добротным текстом застревает на 20-30-й строчке. Почему? Люди заходят - и тут же закрывают вкладку. Причина банальная: страница грузится 5 секунд или навигация запутана. Исправляешь эти проблемы - и через пару месяцев сайт поднимается на 10-15 позиций. Без закупки ссылок, без нового контента.

Хотите разобраться в факторах ранжирования вашего сайта?

Проведу аудит и покажу, что тормозит рост позиций. Бесплатная консультация - 30 минут.

Почему поведенческие факторы решают все

Почему два сайта с похожим контентом стоят на разных позициях? Чаще всего - из-за поведенческих. В Яндексе это один из решающих сигналов. Поисковик анализирует, как люди взаимодействуют с выдачей и с вашим сайтом: кликают ли по сниппету, сколько проводят времени на странице, возвращаются ли обратно в поиск.

В Google за поведенческие отвечает NavBoost - система, которую рассекретила утечка 2024 года. NavBoost хранит историю кликов за 13 месяцев и на ее основе двигает страницы вверх или вниз. Ваш сниппет собирает больше кликов, чем конкуренты? Люди после перехода не бегут обратно в поиск? Алгоритм это фиксирует и поднимает вас выше. О том, что такое CTR и как с ним работать, я писал отдельно.

Вот что реально влияет на поведенческие метрики:

- CTR сниппета - чем привлекательнее title и description, тем больше кликов

- Время на странице - если контент полезный, человек задержится. Если нет - уйдет за 10 секунд

- Глубина просмотра - переходит ли пользователь на другие страницы сайта

- Ну и показатель отказов - быстрый уход говорит поисковику, что страница не ответила на запрос

Накрутка ПФ - отдельная тема и серьезный риск. Яндекс определяет аномалии с точностью 99%. Почему это путь в никуда - подробно разобрал в статье про накрутку ПФ и белое SEO.

Из практики: Один клиент - магазин мебели - застрял в конце третьей страницы выдачи. Тексты написаны нормально, ссылочный профиль в порядке. Начал копать - и нашел корень: на мобильных страница открывалась за 6 с лишним секунд. Семь из десяти посетителей просто не дожидались загрузки. Ускорили до двух секунд - и за восемь недель сайт перескочил на 15-20 строчек вверх. Ни одной новой ссылки за это время не покупали.

E-E-A-T и контент - что хочет видеть поисковик

После декабрьского обновления Google 2025 года принципы E-E-A-T (Experience, Expertise, Authoritativeness, Trustworthiness) расширены на все конкурентные запросы. E-E-A-T - не алгоритм, а фреймворк из руководства для асессоров (Quality Raters), по которому Google оценивает качество контента. Проще говоря: поисковик хочет видеть, что за текстом стоит реальный человек с реальным опытом.

Контент и поведение - два самых весомых фактора ранжирования в 2026 году

Но что именно стоит за этой аббревиатурой?

- Experience (опыт) - автор сам делал то, о чем пишет. Не пересказывал чужие статьи, а работал руками

- Expertise (экспертиза) - глубокое понимание темы, подтвержденное квалификацией и опытом

- Authoritativeness (авторитетность) - на автора ссылаются, его цитируют коллеги по отрасли

- Trustworthiness (надежность) - данные можно проверить, источники указаны, реквизиты на сайте

А что же кроме E-E-A-T?

- Релевантность - насколько страница отвечает на запрос. Работа тут начинается с семантического ядра, без него непонятно, на какие запросы вообще оптимизировать

- Глубина раскрытия - алгоритм Королев оценивает, закрывает ли страница потребность целиком. Поверхностный ответ на полстраницы не пройдет

- Уникальность - оба поисковика пессимизируют копии и рерайт. Грубо говоря, если ваш текст - пересказ чужого, позиций не будет

Яндекс с нейросетями Y3/Y4 определяет AI-контент без экспертной переработки с точностью 99%. Google после декабрьского Core Update 2025 года тоже закрутил гайки - авторский контент стал весить заметно больше. Итог один: тексты, написанные «чтобы было», обе поисковые системы задвигают все дальше.

Техническая база - гигиенический минимум

Без технической базы сайт дальше второй-третьей страницы не двинется. Но сама по себе техника - лишь фундамент, а не гарантия топа.

Core Web Vitals - набор метрик, за которыми Google следит с особым вниманием:

| Метрика | Норма | На что смотрит |

|---|---|---|

| LCP | до 2,5 сек | Как быстро отрисовывается главный блок страницы |

| INP | до 200 мс | Насколько быстро интерфейс реагирует на клик или тап |

| CLS | ниже 0,1 | Не «дергается» ли верстка при загрузке |

С марта 2024 года INP пришел на замену устаревшему FID. Если последний раз вы замеряли скорость до этой даты - самое время перепроверить. Детальный разбор каждого показателя - в материале про скорость загрузки сайта.

Но скоростью дело не ограничивается. Мобильная версия (Google давно перешел на mobile-first индексацию), правильно настроенные robots.txt и sitemap.xml, сертификат HTTPS, разметка Schema.org - все это тоже влияет на позиции. Не забудьте и про чистоту URL: длинные адреса с кучей параметров поисковики не любят.

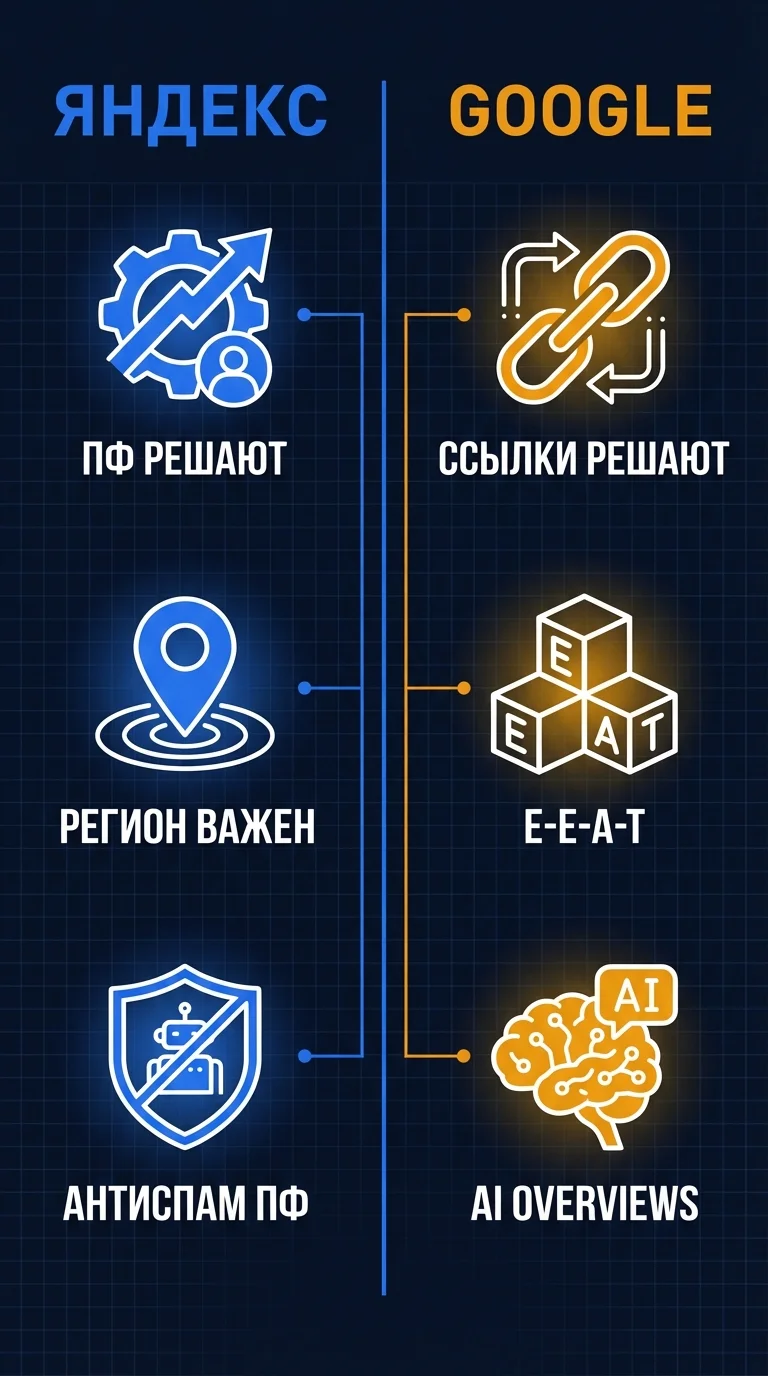

Чем ранжирование в Яндексе отличается от Google

Вот главные различия - проверено на своих проектах:

Ключевые различия: Яндекс ставит на поведение, Google - на ссылки и E-E-A-T

| Фактор | Яндекс | |

|---|---|---|

| Поведенческие факторы | Решающее влияние | Значимое (NavBoost) |

| Ссылочный профиль | Умеренное влияние | Высокое влияние |

| Региональная привязка | Сильная (геозависимость) | Слабая |

| AI-контент | Пессимизация без экспертной доработки | Нейтрально при высоком качестве |

| E-E-A-T | Набирает вес (через ПФ и ИКС) | Не алгоритм, а фреймворк для оценщиков качества |

| Коммерческие факторы | Отдельная группа (ИНН, цены, адрес) | Нет отдельной группы |

| AI-ответы в выдаче | Яндекс Нейро (YandexGPT 5) | AI Overviews (60%+ запросов) |

| Антиспам ссылок | Минусинск (ссылочный фильтр) | Penguin (встроен в ядро) |

Из-за этих различий сайт может занимать топ-3 в Яндексе и одновременно стоять на 20-й позиции в Google. Вижу такое регулярно. Поэтому стратегия продвижения должна учитывать приоритеты обоих поисковиков - универсального рецепта нет.

Региональность в Яндексе

Яндекс сильно привязывает коммерческую выдачу к региону. Сайт из Краснодара по запросу «заказать пиццу» никогда не покажется пользователю из Москвы. Для информационных запросов привязка слабее, но все равно присутствует.

Как AI-поиск меняет правила игры

AI-блоки Google уже покрывают больше 60% запросов. Яндекс Нейро на движке YandexGPT 5 идет тем же путем - собирает информацию из разных источников и выдает готовый ответ. Доля zero-click-запросов неуклонно растет: человек читает генеративную сводку и закрывает вкладку, так и не перейдя ни на один сайт.

Но есть и хорошая новость: если AI процитирует вашу страницу - вы получите трафик даже без классического топ-10. Что для этого нужно?

- Четкие определения в первых абзацах каждой секции - AI выхватывает именно начало

- Структурированные списки и таблицы, которые легко «процитировать»

- Schema.org разметка - Google подтвердил, что использует структурированные данные в AI-функциях поиска

- Ну и главное - реальная экспертиза и факты, а не общие слова

По моим наблюдениям, длинные материалы с четкой структурой цитируются AI-системами в разы чаще, чем короткие и размытые. FAQ-секция с конкретными вопросами и ответами удваивает шансы попасть в генеративную выдачу. Проверено.

Яндекс Нейро

Google AI Overviews

Подробнее о том, как оптимизировать сайт для AI-поисковиков, - на странице GEO-продвижения.

Что делать - пошаговый план

Ранжирование - не черный ящик. За ним стоят измеримые параметры, и с каждым можно работать прицельно. Вот последовательность, которую я рекомендую клиентам:

- Аудит. Не знаете текущую картину - любой следующий шаг будет вслепую. Посмотрите технику, содержимое страниц, ссылки, метрики поведения

- Сначала - техника. Core Web Vitals, адаптация под мобильные, ошибки сканирования. Пока фундамент кривой, все остальное бесполезно

- Потом - контент. Встройте экспертизу: собственные примеры, точные цифры, авторский комментарий к каждому тезису. Цель - чтобы читателю не нужно было уходить на другой сайт

- Следом - работа с поведенческими. Перепишите title и description, разгоните загрузку, уберите лишние шаги в навигации. Задача - удержать посетителя

- Ссылки наращивайте через экспертные публикации, Digital PR, комментарии для СМИ. Биржи ссылок - путь к фильтрам

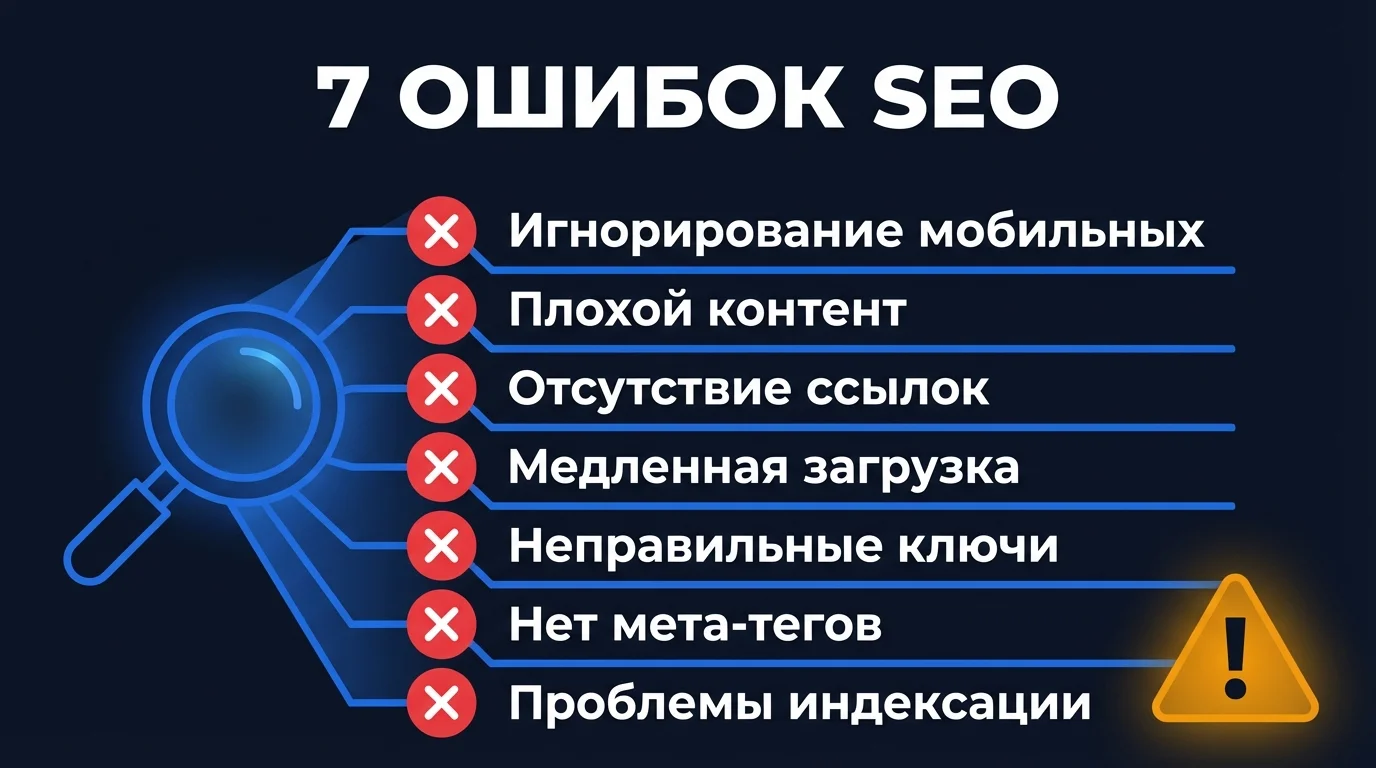

- Проверьте сайт на типичные SEO-ошибки - некоторые из них тихо съедают позиции месяцами

Вес факторов ранжирования (экспертная оценка)

Источник: Обобщение исследований, FedotovSEO 2026

SEO-продвижение - это по сути систематическая работа с факторами ранжирования. Хотите, чтобы я глянул на ваш проект и нашел, что конкретно мешает расти? Напишите в Telegram - разберем.

Хотите понять, почему ваш сайт не растет в выдаче?

Проведу анализ факторов ранжирования вашего сайта и составлю план роста позиций.