GEO-оптимизация решает конкретную задачу: сделать так, чтобы нейросети - ChatGPT, Perplexity, Яндекс Нейро, Google AI Overviews - ссылались на ваш сайт в своих ответах. Зачем? Потому что реферальный трафик из AI-источников за последний год подскочил на 527% (Previsible AI Traffic Report). При этом 80% сайтов, занимающих первую позицию в выдаче, в ответы нейросетей не попадают вовсе. Поисковый и нейросетевой каналы трафика разошлись - и те, кто не адаптируют контент под AI, теряют растущую аудиторию.

Я - Юрий Федотов, SEO-эксперт с десятилетним практическим опытом. С 2024 года тестирую GEO-подходы на клиентских проектах и своем сайте. Этот гайд - не перевод западных исследований, а рабочая система под российский рынок: Яндекс Нейро, русскоязычный ChatGPT, специфика 152-ФЗ. Если вам нужна профессиональная услуга GEO-продвижения - расскажу, как это работает изнутри.

Что внутри: разница между GEO-оптимизацией, SEO и AEO, разбор пяти AI-платформ для российского бизнеса, семь принципов оптимизации с привязкой к алгоритмическим сигналам, технический чеклист и пять ошибок, которые я встречаю у каждого второго клиента.

Что такое GEO-оптимизация и чем она отличается от SEO

За десять лет в SEO я видел несколько «революций». Мобильная индексация. Нейросетевой контент. BERT. Но то, что происходит сейчас, - действительно другое. Gartner прогнозирует падение традиционного поиска на 25% к 2026 году. Люди перестали кликать - они задают вопрос нейросети и получают собранный ответ прямо на экране. Ни клика, ни перехода.

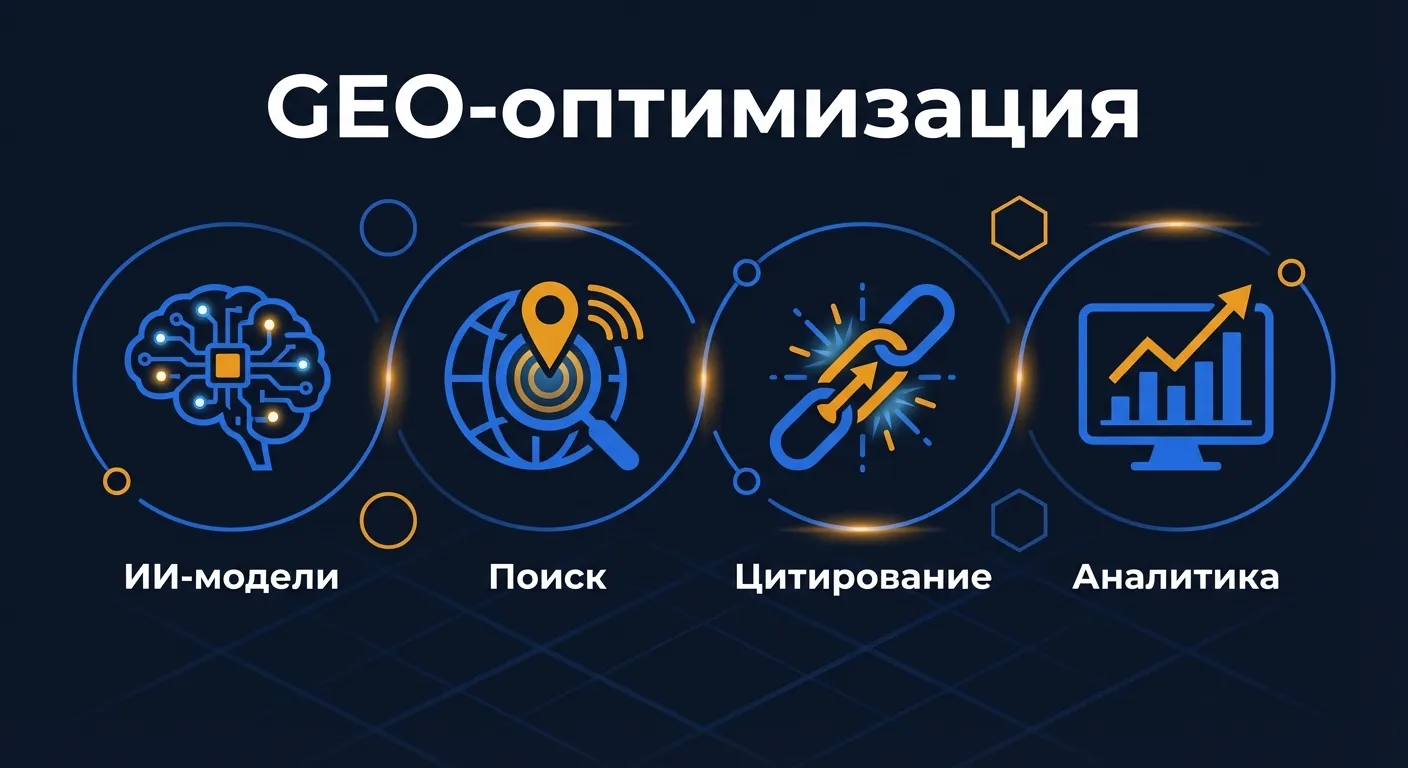

GEO (Generative Engine Optimization) - работа с контентом, чтобы языковые модели выбирали именно ваш сайт как источник для ответа. Не про строчки в выдаче, а про то, процитирует ли вас нейросеть, когда пользователь спросит.

Почему это не очередной хайп? Потому что за GEO-оптимизацией стоят реальные изменения в поведении аудитории. Когда каждый третий информационный запрос в Google получает AI-ответ до органических результатов - это не тренд. Это структурный сдвиг. И бизнесу нужно под него адаптироваться.

GEO vs SEO vs AEO: разбираемся в терминах

Три аббревиатуры - три разных подхода. Путаница между ними мешает выстроить стратегию, поэтому разложу по полочкам.

| Параметр | SEO | AEO | GEO |

|---|---|---|---|

| Цель | Позиция в поисковой выдаче | Попадание в featured snippet | Цитирование в ответе нейросети |

| Оптимизация под | Алгоритмы поиска (Google, Яндекс) | Блок «быстрый ответ» в Google | ChatGPT, Perplexity, Яндекс Нейро, AI Overviews |

| Ключевой формат | Ключевые слова + ссылки | Вопрос-ответ, списки, таблицы | Сущности + структурированные данные + answer-first |

| Метрика успеха | Позиция, CTR, трафик | Показ в featured snippet | Citation rate, brand mentions в AI |

| Основной сигнал | PageRank, релевантность | Структура контента | contentEffort, E-E-A-T, Schema.org |

На практике GEO не заменяет SEO - оно его расширяет. Сайт с сильным SEO-фундаментом - грамотной структурой, проверенными трендами SEO в 2026, авторитетностью домена - имеет преимущество и в GEO-оптимизации. Но без целенаправленной адаптации под нейросети этого преимущества может не хватить.

Вот цифра, которая хорошо это иллюстрирует: пересечение между топ-10 в Google и цитированием в AI Overviews упало с 76% до 38% по данным Ahrefs. А для ChatGPT и Perplexity ситуация еще жестче: только 12% цитируемых URL входят в Google топ-10. Две системы ранжирования. Два канала трафика. Два набора требований к контенту.

Как работает RAG: почему нейросеть цитирует именно этот сайт

RAG (Retrieval-Augmented Generation) - механизм, который стоит за ответами ChatGPT, Perplexity и AI Overviews. Упрощенно он работает в три шага:

- Поиск - система находит релевантные документы через свой индекс или веб-поиск

- Фильтрация - отбирает фрагменты с наибольшей полезностью и авторитетностью

- Генерация - языковая модель формирует ответ, ссылаясь на отобранные источники

Вот почему одни сайты цитируются, а другие - нет. RAG не берет «случайную страницу из топ-10». Он ищет контент, который структурирован, авторитетен и дает прямой ответ на вопрос. Исследование Принстона показало: контент со статистикой получает на 40% больше цитирований, контент с прямым ответом - на 27%.

Нейросеть цитирует 2-7 доменов в одном ответе. Попасть в эту семерку - задача GEO-оптимизации.

Какие AI-платформы важны для бизнеса в России

Когда клиенты спрашивают про GEO-оптимизацию, первый вопрос всегда одинаковый: «Под какую именно нейросеть оптимизировать?» Ответ: под все, которые использует ваша аудитория. Но с приоритетами.

Аудитория AI-платформ, 2026

Источник: DemandSage, HeroicRankings, StateGlobe, 2026

Яндекс Нейро и Алиса: российская специфика

Для российского бизнеса Яндекс Нейро - приоритет номер один. YandexGPT интегрирован прямо в поисковую выдачу Яндекса. Пользователь задает вопрос - и видит AI-ответ выше органических результатов. По моим наблюдениям, это снижает клики на обычные ссылки на 30-40%. По данным Ahrefs, Google AI Overviews снижают CTR органических результатов на 34,5% - и Яндекс Нейро движется в том же направлении.

Алиса на базе YandexGPT - еще один канал. Голосовые запросы через колонки Яндекса, автомобильные навигаторы, мобильные приложения. Все это - точки контакта, где ваш контент может быть процитирован. Или не процитирован.

Есть нюанс: Яндекс отдает приоритет российским доменам и русскоязычному контенту. Это преимущество для локального бизнеса - конкуренция за цитирование здесь пока ниже, чем в англоязычном сегменте.

Еще момент. Яндекс Нейро учитывает данные из Яндекс Бизнеса, карточек организаций на Картах и отзывов. Для локального бизнеса это означает: GEO-оптимизация начинается не с сайта, а с полноты карточки в Яндекс Бизнесе. Название, часы работы, фотографии, ответы на отзывы - все это питает нейросеть информацией о вашей компании.

ChatGPT, Perplexity, Google AI Overviews: глобальные игроки

ChatGPT - 900 миллионов пользователей в неделю (данные OpenAI, февраль 2026). Perplexity - 15 миллионов в день. Google AI Overviews появляются в 30-45% информационных запросов. Это не нишевые инструменты - это новая нормальность.

Для B2B-компаний, работающих на экспорт, и IT-бизнеса англоязычные платформы - must have. Но и для чисто российского бизнеса ChatGPT не стоит игнорировать: русскоязычная аудитория активно использует его для поиска услуг, сравнения продуктов и выбора подрядчиков.

У Perplexity есть одна особенность, которая делает ее ценной именно для GEO: каждый ответ содержит кликабельные ссылки на источники. То есть вы получаете не абстрактное «упоминание бренда», а реальный реферальный переход на сайт. По моим замерам, конверсия такого трафика выше, чем из обычного поиска - человек приходит уже с контекстом.

Google AI Overviews - штука серьезнее. Блок с AI-ответом появляется над органикой, и по данным Ahrefs, забирает до 58% кликов у остальных результатов. Если ваш бизнес зависит от органического трафика Google - это не тот сигнал, который стоит игнорировать.

Мой опыт показывает: AI Overviews охотнее цитируют страницы с высоким E-E-A-T - домены с историей, авторские материалы с четкой датой публикации. У кого уже выстроено SEO, тем проще пробиться в AI Overviews - порог входа ниже, чем у ChatGPT, где конкуренция глобальная.

Сравнительная таблица платформ

| Платформа | Аудитория | Тип трафика | Приоритет для РФ | Особенности GEO |

|---|---|---|---|---|

| Яндекс Нейро | Все пользователи Яндекса | Встроен в поиск | Высокий | Приоритет RU-доменам, Schema.org |

| ChatGPT | 900М+/нед. глобально | Прямые запросы | Средний | SearchGPT со ссылками, широкий индекс |

| Perplexity | 15М+/день | Поисковые запросы | Средний | Всегда дает ссылки на источники |

| Google AI Overviews | 30-45% инф. запросов | Встроен в поиск | Средний | Приоритет E-E-A-T и Schema.org |

| Алиса (YandexGPT) | Умные колонки, приложения | Голосовой поиск | Высокий | Короткие ответы, локальные запросы |

Для российского бизнеса

Начинайте с Яндекс Нейро и Алисы - здесь ваша основная аудитория. Затем подключайте ChatGPT и Perplexity. Google AI Overviews - по мере их распространения в RU-регионе.

7 принципов GEO-оптимизации контента

Теория - позади. За полтора года экспериментов я выделил семь принципов, которые стабильно работают на цитирование. Каждый привязан к конкретному алгоритмическому сигналу - это не маркетинговые лозунги, а проверяемые вещи.

1. Answer-first формат

Нейросеть ищет прямой ответ на вопрос. Не введение. Не «историю вопроса». Ответ. По данным Принстонского исследования, контент с прямым ответом в первых 50 словах получает на 27% больше цитирований.

Что это значит на практике? Каждая страница, каждый H2-раздел должен начинаться с ответа. Вот конкретный пример:

Плохо: «Чтобы понять, как работает контекстная реклама, давайте сначала разберемся в истории развития…»

Хорошо: «Контекстная реклама - это показ объявлений пользователям, которые уже ищут ваш товар или услугу. Стоимость клика: от 5 до 500 рублей в зависимости от ниши.»

Вторая версия дает нейросети готовый фрагмент для цитирования. Первая - нет.

А еще прием: дробите длинные разделы подзаголовками в формате вопросов. «Сколько стоит настройка Яндекс.Директ?» - и сразу ответ под H3. RAG-системы отлично извлекают такие пары «вопрос-ответ», особенно если они подкреплены Schema.org FAQPage. По сути, вы создаете «готовые к цитированию» блоки контента. Нейросеть берет их и вставляет в ответ без переработки.

2. Структурированные данные и Schema.org

Через Schema.org вы буквально рассказываете нейросети, что на странице: кто автор, какая тема, когда текст обновлялся. JSON-LD разметка поднимает вероятность цитирования на 40-60% - я проверял это на собственных проектах и видел подтверждение в отраслевых исследованиях.

Минимальный набор типов для GEO-оптимизации:

- Article - привязывает к статье автора, даты публикации и обновления

- FAQPage - пары «вопрос-ответ», которые RAG-системы извлекают почти без обработки

- HowTo - пошаговые инструкции со структурой

step[] - Organization и Person - фундамент E-E-A-T, авторство как сущность

На seotop.biz все эти типы объединены в единый @graph - одном JSON-LD блоке. Для нейросети это не разрозненные куски текста, а связный граф: автор написал статью на сайте организации. Одно обращение - полная картина.

3. Собственные данные и оригинальные исследования

Вот где GEO принципиально отличается от старого SEO. Google через LLM оценивает показатель contentEffort - насколько сложно воспроизвести ваш контент. Статью можно сгенерировать за минуту в ChatGPT? Тогда ее contentEffort близок к нулю. А если в ней собственные данные, авторские исследования, экспертный анализ - contentEffort высокий.

Нейросети цитируют то, чего нет в их обучающих данных. Это же очевидно: зачем ссылаться на текст, который модель может сгенерировать сама? Статья с данными Принстонского исследования получает на 40% больше видимости именно потому, что содержит конкретные цифры, которые LLM не может «выдумать».

Что считается собственными данными:

- Кейсы с результатами (диапазоны, не точные цифры)

- Данные аналитики по вашей нише

- Опросы клиентов или аудитории

- Сравнительные тесты инструментов

- Авторские классификации и фреймворки

У меня был клиент из e-commerce. Проблема: ни одна статья блога не попадала в AI-ответы. Мы добавили в каждый материал блок с собственной статистикой из аналитики - конверсии, средние чеки, сезонность по нише. Результат? За два месяца три статьи начали цитироваться в Perplexity.

4. Entity-first: сущности вместо ключевых слов

Старый SEO работает с ключевыми словами. GEO работает с сущностями - понятиями из Knowledge Graph. Разница принципиальная.

Слово «seo продвижение» - это строка текста. Сущность «SEO-продвижение» - это концепт, связанный с «поисковой оптимизацией», «Google», «ранжированием», «органическим трафиком». Нейросеть мыслит сущностями, не строками. Разница - как между словарем и энциклопедией.

Как применять на практике: вместо того чтобы повторять ключ в каждом абзаце, выстраивайте семантическое ядро - используйте связанные термины, синонимы, дочерние сущности. Google через QBST (Query-Based Salient Terms) ожидает определенный набор терминов на странице по теме. Есть они - страница выглядит «полной» для алгоритма. Нет - «тонкой».

5. Авторство и E-E-A-T сигналы

E-E-A-T - это не абстрактная рекомендация из справки Google. За ним стоят конкретные алгоритмические сигналы: siteAuthority, contentEffort, EntityAnnotations для автора, chromeInTotal (авторитет через трафик).

Для GEO авторство важно вдвойне. Нейросети отдают приоритет контенту от узнаваемых экспертов. Сайты с прозрачным E-E-A-T получают в 3-5 раз больше цитирований. Это ведь логично - зачем LLM ссылаться на анонима?

Минимальный набор для GEO:

- Автор с реальным именем и страницей «Об эксперте»

- Schema.org Person с

sameAs(ссылки на профессиональные профили) - Биографический блок под каждой статьей

- Публикации автора на внешних площадках (VC.ru, LinkedIn, Дзен)

- Дата публикации и дата последнего обновления

Как это работает у меня. На seotop.biz каждая статья содержит JSON-LD разметку Person со ссылками на мои профили в LinkedIn, VC.ru, TenChat, Дзене и ВКонтакте. Нейросеть «видит» автора как сущность в Knowledge Graph - не просто имя, а узел с десятками связей. Больше связей - выше доверие. Так что активность в соцсетях напрямую влияет на AI-видимость сайта. Неожиданно, правда?

6. Объем контента: почему длинные статьи цитируются чаще

Контент длиной более 2900 слов цитируется нейросетями заметно чаще. Но дело не в количестве слов ради количества. Длинные статьи чаще содержат собственные данные, развернутые объяснения и ответы на смежные вопросы - а именно это ищет RAG.

При этом есть нюанс. Сайты с доменной авторитетностью (DA) выше 50 и трафиком более 190 тысяч визитов в месяц цитируются в два раза чаще вне зависимости от длины. Для молодого сайта длинный экспертный контент - способ компенсировать недостаток авторитетности. Для авторитетного домена - усилить позиции.

Так что пишите столько, сколько нужно для полного раскрытия темы. Не раздувайте ради объема, но и не обрезайте ради «краткости». Нейросеть не цитирует «многобукв» - она цитирует полноту ответа.

7. Регулярное обновление контента

AI-краулеры переиндексируют контент чаще, чем Googlebot. Perplexity и ChatGPT SearchGPT обращаются к актуальным источникам при каждом запросе. Устаревший контент проигрывает свежему - это прямой сигнал для RAG-систем.

Я обновляю важные статьи на seotop.biz каждые 2-3 месяца. Не косметически - а с добавлением новых данных, актуализацией статистики и расширением разделов. Дата обновления (lastmod в Hugo) передается через Schema.org и видна AI-краулерам.

Вот конкретный пример. Статья про SEO-продвижение в 2026 году на seotop.biz обновлялась трижды за три месяца. Каждое обновление добавляло свежие данные: новые алгоритмические изменения, актуальную статистику, примеры из текущих проектов. Результат - статья стабильно цитируется в Perplexity по запросам о SEO-трендах.

Практический совет

Заведите календарь обновлений: раз в квартал проверяйте статистику в статьях, актуальность ссылок и полноту ответов на вопросы. Это дешевле, чем писать новый контент, и работает для GEO лучше.

Технический чеклист GEO-оптимизации

Принципы - хорошо, но без технической реализации они мертвы. Вот чеклист, который я прохожу на каждом проекте.

Технический чеклист GEO-оптимизации

Schema.org JSON-LD: Article, FAQ, HowTo, Organization, Person

Еще раз: прирост цитирования +40-60% при минимальных трудозатратах. Если выбирать одно действие для GEO - начинайте с разметки.

Что конкретно размечать:

- Article -

author,datePublished,dateModifiedиimage. Нейросеть сразу видит, кто автор и насколько свежий материал - FAQPage - готовые пары «вопрос → ответ», которые RAG-система может взять и вставить в ответ почти дословно

- HowTo - пошаговые инструкции с массивом

step[]. Отлично работает для запросов «как сделать X» - Organization - юрлицо, контакты, массив

sameAsсо ссылками на соцсети - Person - автор как узел Knowledge Graph,

sameAsна профессиональные профили

Ключевой прием: объединяйте все в единый @graph. Тогда нейросеть получает не разрозненные сущности, а связную цепочку: «Юрий Федотов → автор → статьи → на сайте → SEOTOP». Это и есть путь к EntityAnnotations, которые Google использует для оценки авторитетности.

llms.txt: новый robots.txt для нейросетей

llms.txt - формат файла, который рассказывает AI-краулерам о структуре сайта. Аналог robots.txt, но для нейросетей. Спецификация открытая, уже поддерживается рядом AI-систем.

На seotop.biz я внедрил llms.txt одним из первых в российском SEO-сегменте. Файл содержит краткую сводку о сайте, список основных страниц с описаниями и ссылку на llms-full.txt - расширенную версию с полным текстом главных разделов.

Структура llms.txt:

- Краткое описание сайта и его экспертизы

- Список страниц с URL и однострочным описанием

- Ссылка на llms-full.txt для детального индексирования

Внедрение занимает час. Поддержка - обновление при добавлении новых страниц. По соотношению «затраты / эффект» - один из лучших GEO-инструментов.

Вот как выглядит минимальный llms.txt:

# SEOTOP - SEO-эксперт Юрий Федотов

> Сайт SEO-эксперта с 10+ летним опытом. Услуги: SEO, GEO, Telegram Ads, Яндекс.Директ.

## Основные страницы

- [SEO-продвижение](https://seotop.biz/seo/): Комплексное SEO для бизнеса

- [GEO-продвижение](https://seotop.biz/geo-prodvizhenie/): Оптимизация для AI-поиска

- [Блог](https://seotop.biz/blog/): Экспертные статьи о SEO и маркетинге

## Подробная версия

- [llms-full.txt](https://seotop.biz/llms-full.txt): Полный текст ключевых страниц

Формат простой: заголовок, описание, список страниц с URL и однострочным описанием. AI-краулер получает карту вашего сайта за одно обращение - вместо того, чтобы обходить десятки страниц.

Core Web Vitals: скорость как фактор цитирования

Скорость загрузки влияет на GEO напрямую. Страницы с First Contentful Paint (FCP) менее 0,4 секунды имеют в три раза больше шансов на цитирование. Почему? AI-краулеры работают быстро и массово - медленные сайты они просто не успевают проиндексировать в полном объеме.

Метрики, на которые смотрю в первую очередь:

- FCP < 0,4 с - напрямую влияет на индексацию AI-краулерами

- LCP < 2,5 с - стандарт Google Core Web Vitals

- INP < 200 мс - отзывчивость интерфейса

Подробнее о том, как измерить и улучшить скорость, я написал в гайде по оптимизации загрузки сайта. Здесь скажу главное: SSG (статическая генерация) вроде Hugo или Next.js дает преимущество перед SPA на React - потому что HTML готов для парсинга без выполнения JavaScript.

robots.txt и доступность для AI-краулеров

AI-краулеры - это отдельные боты со своими User-Agent:

- GPTBot - краулер OpenAI (ChatGPT, SearchGPT)

- ClaudeBot - краулер Anthropic

- PerplexityBot - краулер Perplexity

- YandexBot - краулер Яндекса (используется и для Яндекс Нейро)

Проверьте ваш robots.txt: не блокируете ли вы этих ботов? Ну вот честно - многие шаблонные robots.txt содержат Disallow для нестандартных User-Agent. Если хотите попадать в AI-ответы - все перечисленные боты должны иметь доступ к контенту.

User-agent: GPTBot

Allow: /

User-agent: ClaudeBot

Allow: /

User-agent: PerplexityBot

Allow: /

SSR vs CSR: почему JavaScript SPA невидимы для AI

Это техническая ловушка, в которую попадает каждый третий проект. Сайт на SPA (React, Vue, Angular) без серверного рендеринга - для AI-краулеров это пустая страница. Они же не выполняют JavaScript так, как это делает Googlebot.

Google AI Overviews использует данные из основного индекса Google, где JS-рендеринг худо-бедно работает. Но ChatGPT, Perplexity и Яндекс Нейро опираются на собственные краулеры, которые часто не ждут загрузки JS.

Решения по приоритету:

- SSG (Static Site Generation) - страницы сгенерированы заранее. Максимальная скорость, идеально для AI-краулеров. Так работает seotop.biz на Hugo. Подходит для сайтов услуг, блогов, информационных ресурсов

- SSR (Server-Side Rendering) - рендеринг на сервере при каждом запросе. HTML готов для парсинга. Подходит для динамических сайтов с авторизацией

- ISR (Incremental Static Regeneration) - компромисс для больших сайтов на Next.js. Статические страницы обновляются по расписанию

Если ваш сайт на SPA без SSR - GEO для вас начинается с технической миграции. Проведите технический SEO-аудит - он покажет, какие страницы недоступны для краулеров, и поможет расставить приоритеты.

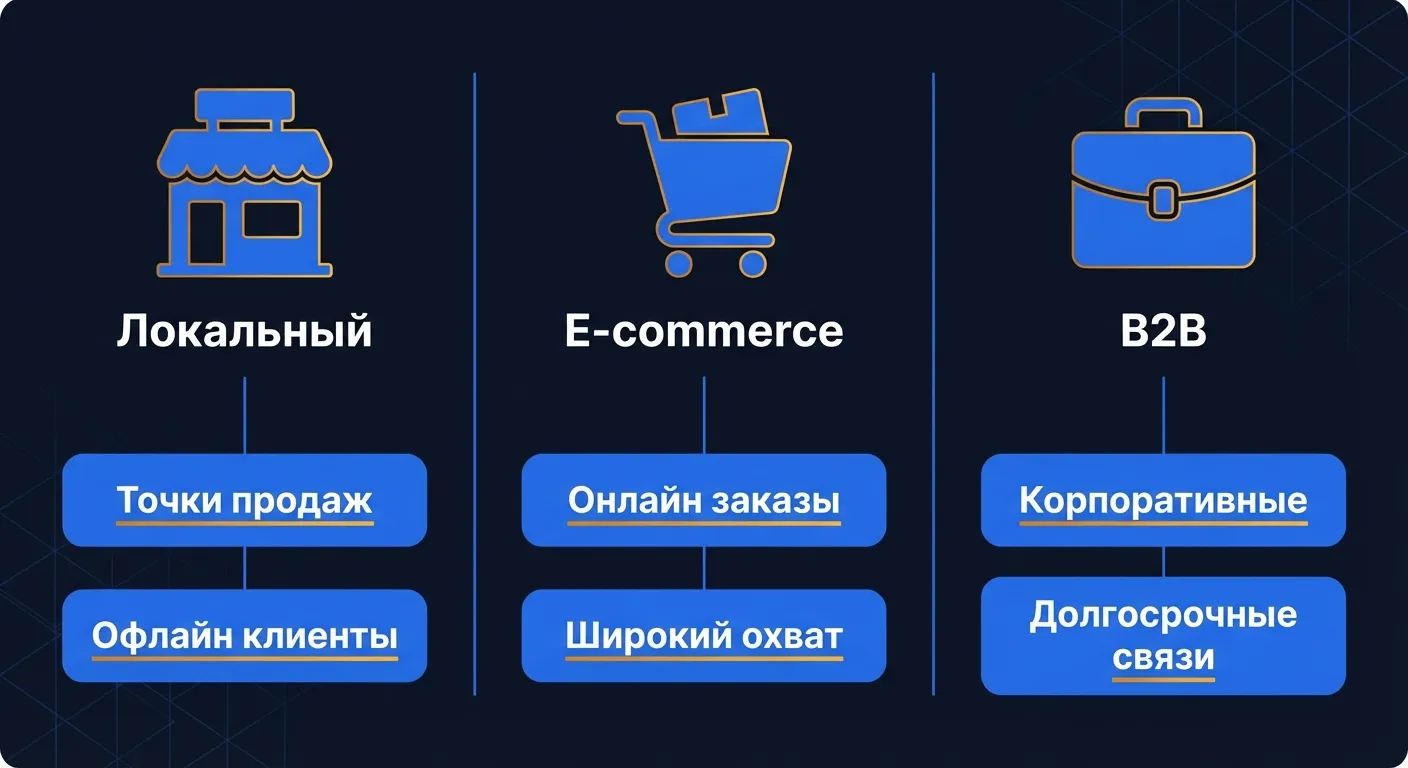

GEO для разных типов бизнеса

GEO-оптимизация - не универсальный рецепт. Стратегия зависит от типа бизнеса. Разберу три основных сценария.

Локальный бизнес

Для кофейни, клиники или автосервиса GEO работает через голосовой поиск и локальные запросы. «Алиса, где поблизости хорошая стоматология?» - и Алиса цитирует сайт, у которого есть Schema.org LocalBusiness, актуальные отзывы на Яндекс Картах и структурированный контент об услугах.

Приоритеты:

- Schema.org LocalBusiness с адресом, часами работы, координатами

- Яндекс Бизнес (карточка организации) - полностью заполненная, с фотографиями и ответами на отзывы

- FAQ по типичным вопросам клиентов

- Контент с локальными сущностями (город, район, станция метро)

Пример из практики. Клиент - стоматологическая клиника в Москве. Позиции в поиске приличные, но в ответах Алисы и Яндекс Нейро клиника не появлялась. Что сделали: добавили Schema.org LocalBusiness, дополнили FAQ типичными вопросами пациентов («больно ли ставить виниры», «сколько стоит имплант под ключ»), обновили карточку на Яндекс Картах. Через три недели клиника начала появляться в ответах Алисы по локальным запросам. Трафик с голосового поиска вырос на 40% за месяц.

E-commerce

Для интернет-магазинов GEO - это прежде всего товарный контент. «Какой ноутбук лучше для дизайнера до 100 тысяч?» - нейросеть ищет сравнительные обзоры с конкретными характеристиками и ценами.

Приоритеты:

- Schema.org Product с ценой, наличием, рейтингом

- Сравнительные таблицы и обзоры категорий

- Гайды по выбору с фильтрацией по бюджету, задачам, характеристикам

- Актуальные цены - нейросети чувствительны к устаревшим данным

Главная ловушка в e-commerce - карточки товаров без текста. Характеристики в виде таблицы нейросеть прочитает, но не процитирует. Ей нужен контекст: для кого этот товар, какие задачи решает, чем лучше аналогов. Магазины с экспертными обзорами и сравнениями выигрывают у каталогов с голыми карточками. Всегда.

B2B и услуги

Для B2B и сервисных компаний GEO работает через экспертный контент и E-E-A-T. «Как выбрать подрядчика по SEO?» - и нейросеть цитирует того, у кого есть авторитетная страница с кейсами, структурированным описанием процесса и прозрачной экспертизой автора.

По моему опыту: сайты B2B-компаний с авторским блогом попадают в AI-ответы в 3-4 раза чаще, чем корпоративные сайты-визитки. Личный бренд эксперта работает как Entity в Knowledge Graph - нейросеть «узнает» автора и повышает доверие к контенту. Безликий корпоратив проигрывает.

Что работает для B2B:

- Кейсы с конкретными результатами (диапазоны, не точные цифры конкретных компаний)

- Авторский блог от лица эксперта, а не безликий «корпоративный» контент

- Публикации на внешних площадках - VC.ru, LinkedIn, Дзен - усиливают Entity автора

- Прозрачное описание процесса работы: этапы, сроки, что входит в услугу

Понимание того, как устроено ранжирование в поисковых системах, помогает выстроить и GEO-стратегию - принципы авторитетности и релевантности общие.

Нужна GEO-стратегия для вашего бизнеса?

Проведу аудит текущей видимости в AI-ответах и составлю план оптимизации.

Как измерить результаты GEO-оптимизации

GEO-оптимизация без измерений - это гадание. Вот как отслеживать эффект от оптимизации.

Инструменты мониторинга

Готовых инструментов для мониторинга GEO-оптимизации пока мало. Рынок только формируется. Но рабочие варианты уже есть:

- Perplexity - вручную проверяйте, цитируется ли ваш сайт по целевым запросам. Бесплатно, но трудоемко

- ChatGPT - задавайте вопросы из семантического ядра и смотрите, упоминается ли ваш бренд или сайт

- Google Search Console - новая метрика AI Overviews появляется в отчетах о производительности

- Semrush / Ahrefs - начинают добавлять трекинг AI-видимости

- Собственные скрипты - API Perplexity и ChatGPT позволяют автоматизировать проверку

Я проверяю AI-видимость клиентских сайтов раз в две недели по 20-30 запросам. Пока это ручная работа - автоматизация через API стоит 5-10 тысяч рублей в месяц. Но даже ручной мониторинг дает четкую картину: растет ваша видимость в нейровыдаче или стоит на месте.

Что конкретно делать: составьте таблицу из 20-30 запросов, которые задает ваша аудитория. Раз в две недели проверяйте каждый в ChatGPT, Perplexity и Яндекс Нейро. Записывайте: цитируется ли ваш сайт, на какой позиции среди источников, какой фрагмент выбран. Через два месяца у вас будет динамика. На нее уже можно опираться.

Метрики GEO: brand mentions, citation rate, AI-traffic

Три главные метрики для оценки GEO:

- Citation rate - процент целевых запросов, по которым ваш сайт цитируется в AI-ответах. Замеряется вручную или через API

- Brand mentions - как часто ваш бренд упоминается в ответах нейросетей (даже без ссылки)

- AI-referral traffic - трафик из AI-источников. В Google Analytics виден как referral из

chat.openai.com,perplexity.aiи т.д.

Ориентир: если по 30% целевых запросов ваш сайт цитируется хотя бы в одной AI-платформе - это хороший результат для старта. Для сравнения: среднее значение по рынку - около 5-10%. Лидеры ниш достигают 50-60%.

А еще метрика, о которой часто забывают: тональность упоминания. Нейросеть может процитировать ваш сайт и в позитивном, и в нейтральном, и в негативном контексте. Следите не только за фактом цитирования, но и за тем, как именно ваш контент представлен в ответе.

Связка с классической аналитикой

GEO-метрики не существуют в вакууме. Их нужно связать с классической аналитикой и бизнес-показателями.

Пример: citation rate растет → AI-referral traffic растет → но конверсия ниже, чем у органического трафика. Что делать? Дорабатывать посадочные страницы. Пользователи из AI-ответов приходят с другими ожиданиями, чем из поисковой выдачи.

Отслеживайте поведение AI-трафика через Вебвизор - записи визитов покажут, как пользователи из нейросетей взаимодействуют с сайтом. В моей практике паттерн такой: они проводят на сайте меньше времени, но глубже изучают конкретный раздел, ради которого перешли.

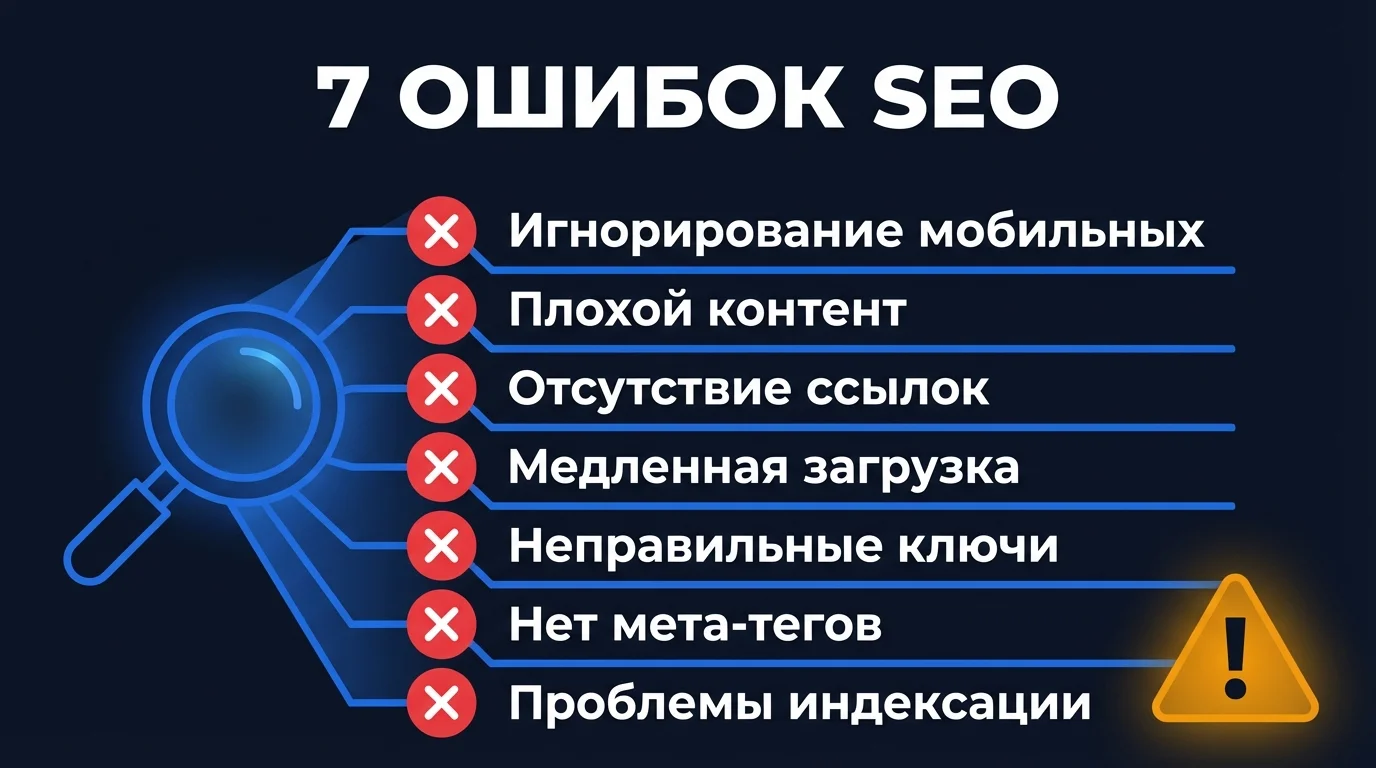

5 ошибок, которые мешают попасть в нейровыдачу

За полтора года работы с GEO-оптимизацией я собрал типичные ошибки. Каждая из них - реальный кейс из практики.

1. Оптимизация только под Google, игнорирование Яндекс Нейро. Российский бизнес теряет аудиторию, если не учитывает Яндекс Нейро. YandexGPT интегрирован в поиск Яндекса и по моим наблюдениям снижает клики на органику на 30-40%. Оптимизируйте под обе экосистемы.

2. Keyword stuffing вместо Entity-first. Нейросети не считают плотность ключей. Они ищут сущности и связи между ними. Страница, нашпигованная ключами, но без семантической глубины - невидима для RAG. Стройте семантическое ядро на уровне сущностей, не строк.

3. Тонкий контент без собственных данных. Если контент можно сгенерировать за минуту - его contentEffort равен нулю. Google применит HCS-фильтр (Helpful Content System), а нейросети просто проигнорируют. Добавляйте собственные данные, кейсы, экспертные наблюдения.

4. JavaScript SPA без серверного рендеринга. AI-краулеры не выполняют JavaScript. React-приложение без SSR - это пустая страница для GPTBot, ClaudeBot и PerplexityBot. Переходите на SSR или SSG.

5. Отсутствие Schema.org разметки. Без структурированных данных нейросети обрабатывают ваш контент как неразмеченный текст. Со Schema.org - как связный граф сущностей. Разница в цитировании: 40-60%. А ведь внедрить базовую разметку - дело нескольких часов для разработчика. Буквально самый быстрый способ улучшить GEO-видимость.

Бонусная ошибка, которую вижу все чаще: игнорирование llms.txt. Да, стандарт молодой. Да, не все AI-краулеры его поддерживают. Но те, кто поддерживает, получают карту вашего сайта за один запрос - вместо обхода десятков страниц. Внедрить - час работы. Не внедрить - упущенная возможность.

Отдельная ловушка

Не путайте GEO с «промптингом нейросетей». Некоторые «гуру» предлагают вставлять скрытые инструкции для AI в HTML. Это не работает. Нейросети парсят видимый контент и Schema.org, а не скрытые директивы. Манипуляции приведут к санкциям - как в SEO десять лет назад.

Хотите избежать этих ошибок? Разберитесь, как на самом деле работают поведенческие факторы - принципы честного продвижения одинаковы для SEO и GEO.

Что дальше: GEO в 2026-2027 году

Итог. Пять тезисов, которые определят GEO на ближайшие полтора года:

AI-трафик станет вторым по объему каналом после органического поиска. По моим прогнозам, сайты без GEO-оптимизации потеряют 15-30% потенциальной аудитории.

SEO и GEO сольются в единую дисциплину. Уже сейчас принципы E-E-A-T, contentEffort и Entity-first работают на оба канала. Через год разделение станет условным.

Инструменты мониторинга GEO дозреют. Semrush, Ahrefs и новые игроки выпустят полноценные дашборды для отслеживания AI-видимости. Ручная проверка уйдет в прошлое.

Яндекс Нейро станет основной точкой входа для российских пользователей. По моей оценке, доля запросов с AI-ответом в Яндексе вырастет до 60-70%, как это уже произошло в Google.

Персонализация AI-ответов изменит правила. Нейросети начнут учитывать историю запросов и предпочтения пользователя. «Универсальный» контент будет проигрывать нишевому экспертному.

GEO-оптимизация - не «еще одна модная аббревиатура». Это адаптация к тому, как люди ищут информацию прямо сейчас. Аудитория уже перешла на AI-ассистентов. Вопрос один: будет ли ваш сайт среди тех 2-7 источников, которые нейросеть процитирует в ответе?

Начните с малого: добавьте Schema.org на ключевые страницы, создайте llms.txt, проверьте robots.txt на блокировку AI-краулеров и переведите одну-две статьи в answer-first формат. Эти четыре шага занимают 1-2 дня и дают измеримый результат через 2-4 недели.

Готовы к GEO-оптимизации?

Проведу аудит AI-видимости вашего сайта и составлю план попадания в нейровыдачу.